特朗普要求联邦机构停用 Anthropic,五角大楼 AI 用途之争升级

理论用途之争

美国国防部曾施压 Anthropic,要求其取消对军方使用 AI 方式的限制。

2023 年 7 月 25 日(周二),Anthropic CEO Dario Amodei 出席参议院司法委员会隐私、技术与法律小组委员会举行的 AI 听证会。图片来源:Getty Images | Bloomberg

美国总统 Donald Trump 周五宣布,他已指示所有联邦机构“立即停止”使用 Anthropic 的 AI 工具。此举之前,围绕人工智能在军事场景中的应用, Anthropic 与美国高层官员已持续数周发生冲突。

“Anthropic 那帮左翼疯子试图对战争部搞强硬施压,这是一个灾难性的错误(DISASTROUS MISTAKE),”Trump 在 Truth Social 的帖子中写道。

Trump 表示,正在使用 Anthropic 的机构将有“六个月的逐步退出期(phase out period)”,这也可能为政府与这家 AI 创业公司进一步谈判留出时间。

五角大楼和 Anthropic 尚未立即回应置评请求。

美国国防部一直试图修改其去年 7 月与 Anthropic 及其他公司达成的协议条款:取消对 AI 部署方式的限制,改为允许该技术用于“所有合法用途(all lawful use)”。Anthropic 反对这一调整,称其可能导致 AI 被用于完全控制致命自主武器,或对美国公民实施大规模监控。

五角大楼目前并未以这些方式使用 AI,也表示暂无此类计划。不过,Trump 政府高层官员反对由一家民间科技公司来规定这种关键技术在军事上的使用边界。

Anthropic 是首家与美军合作的大型 AI 实验室,双方去年签署了一项2 亿美元协议。该公司为此打造了多个定制模型,统称 Claude Gov,其限制少于常规版本。Google、OpenAI 和 xAI 也在同期签署了类似协议,但目前只有 Anthropic 在与涉密系统合作。

Anthropic 的模型可通过 Palantir 提供的平台以及 Amazon 面向涉密军事任务的云平台使用。知情人士向 WIRED 匿名表示(因无权公开谈论此事),Claude Gov 目前主要用于撰写报告、总结文档等常规任务,但也被用于情报分析和军事规划。

近些年,硅谷从普遍回避国防项目,转向日益拥抱,并最终成为深度军工承包方。Anthropic 与五角大楼的这场冲突,正在测试这一转向的边界。本周,OpenAI 和 Google 的数百名员工联署公开信,声援 Anthropic,并批评各自公司取消 AI 军事用途限制的决定。

据《华尔街日报》报道,OpenAI CEO Sam Altman 在当天发给员工的备忘录中表示,公司认同 Anthropic 的立场,也将大规模监控和全自主武器视为“红线(red line)”。Altman 还称,公司将争取与五角大楼达成协议,以便继续与军方合作。

五角大楼与 Anthropic 的公开争执,始于 Axios 报道:美国军方领导层曾使用 Claude 协助规划抓捕委内瑞拉总统Nicolás Maduro的行动。行动后,Palantir 一名员工曾将 Anthropic 某员工对模型使用方式的担忧转达给美军高层。Anthropic 否认曾提出此类担忧或干预五角大楼使用其技术。

Anthropic 与美国国防部的争端在最近几天进一步升级,双方官员在社交媒体上公开互相抨击。

据一位了解互动情况但无权公开发言的知情人士称,美国国防部长 Pete Hegseth 本周早些时候与 Anthropic CEO Dario Amodei 会面。他要求 Anthropic 在周五前承诺修改合同条款,允许模型用于“所有合法用途”。该人士还表示,Hegseth 在会谈中肯定了 Anthropic 的产品,并称国防部希望继续与其合作。

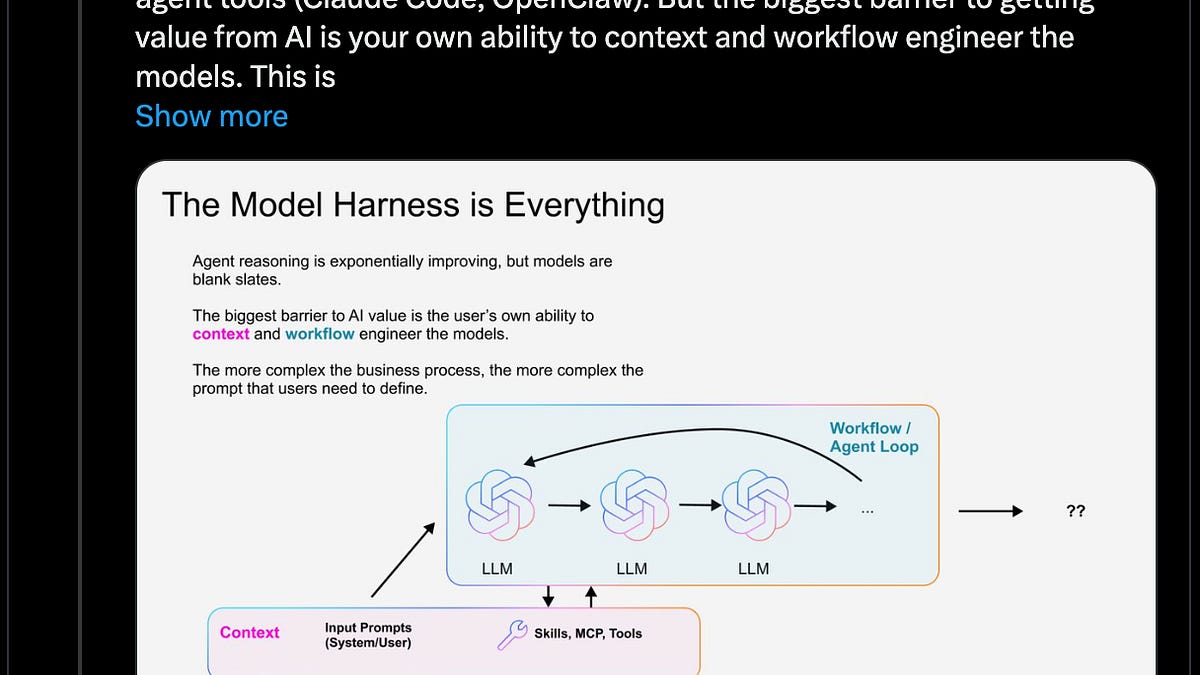

一些专家认为,这场争议更像是“立场与氛围”的冲突,而非 AI 应如何部署上的实质分歧。“在我看来,这场争端完全没必要,”曾任五角大楼新兴技术副助理国防部长、现为军事 AI 专家的 Michael Horowitz 表示,“争论点是目前并未摆上桌面的理论用途。”

Horowitz 指出,迄今为止,Anthropic 对国防部提出的所有技术使用方式都表示支持。“我的感觉是,五角大楼和 Anthropic 目前在‘哪些场景下技术还不够成熟、不能正式上阵’这一点上是有共识的,”他补充道。

Anthropic 创立之初就强调“以安全为核心”构建 AI。Amodei 在今年 1 月撰写的一篇博客文章中讨论了强大 AI 的风险,其中也提到全自主 AI 控制武器的危险。

“这些武器在捍卫民主时也有其正当用途,”Amodei 写道,“但它们是危险的武器。”

补充报道:Paresh Dave。

本文最初发表于 WIRED.com

Wired.com 是你理解“下一步将发生什么”的每日核心指南,持续提供关于创新如何影响技术、科学、商业与文化的原创且完整报道。

原文链接:https://arstechnica.com/tech-policy/2026/02/trump-moves-to-ban-anthropic-from-the-us-government/