执行框架工程真有价值吗?

深度Latent Space2026年3月5日6 分钟阅读

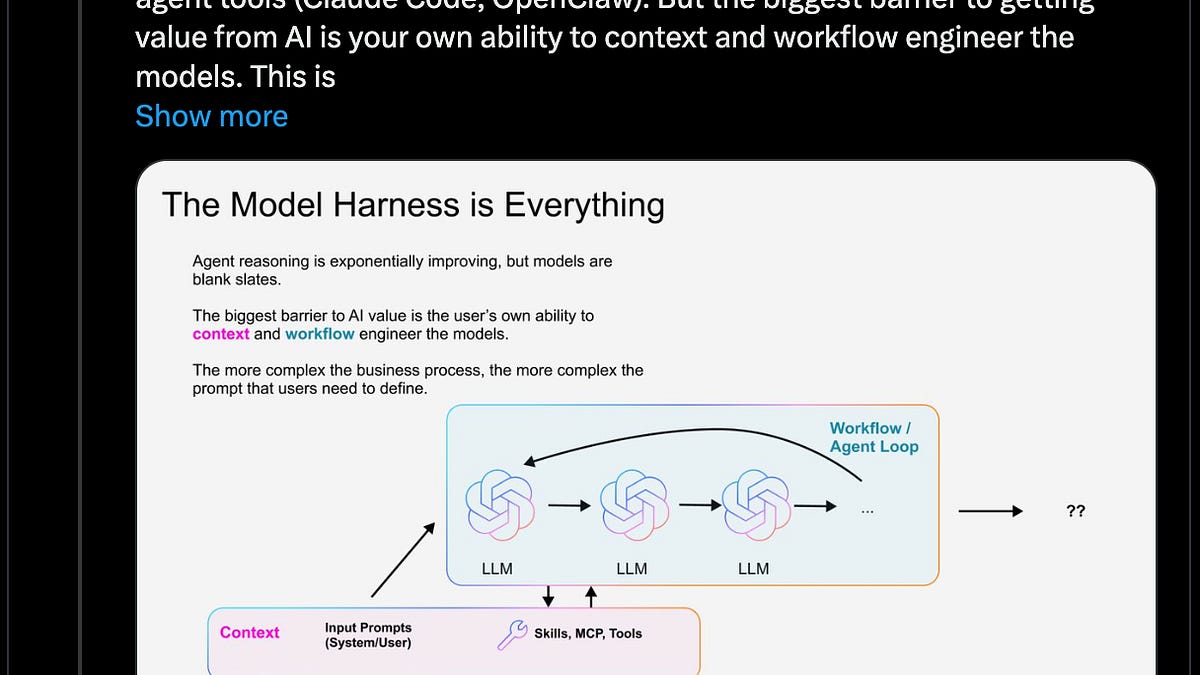

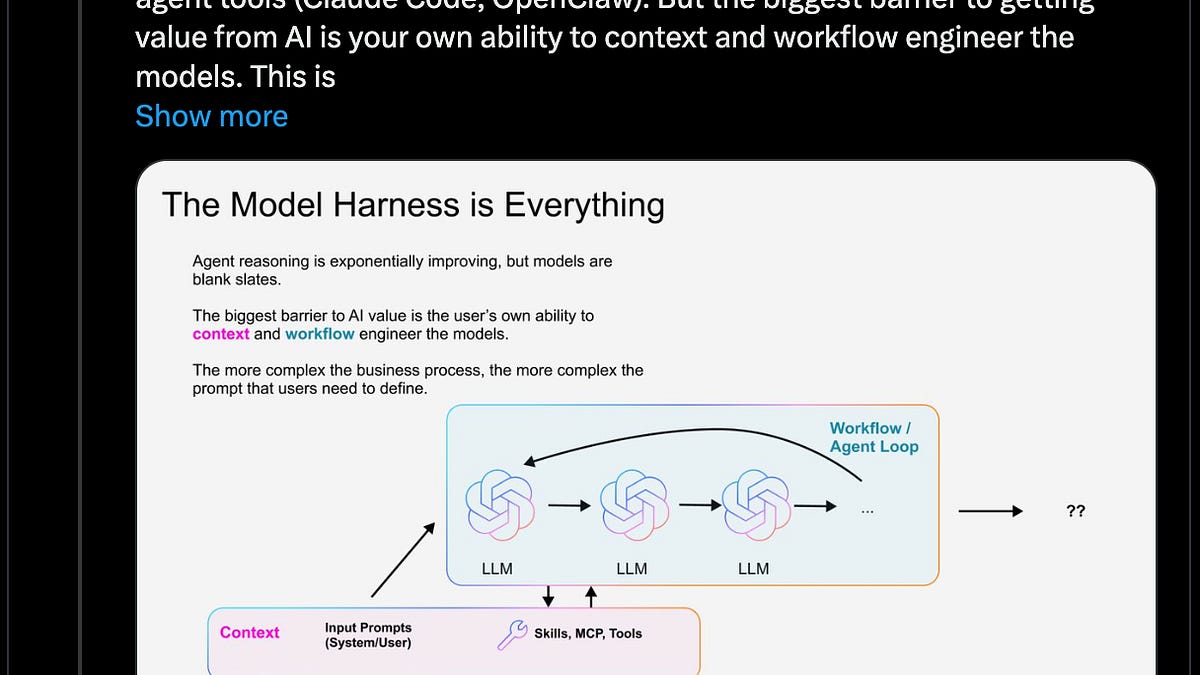

AI 工程界正激烈争论:智能体的核心价值究竟来自大模型本身,还是包裹它的执行框架(Harness)?Claude Code 团队认为框架越薄越好,而另一些团队则用数据证明优化框架能显著提升所有模型表现。

本文编译自 [AINews] Is Harness Engineering real?,版权归原作者所有。

觉得有用?分享给更多人

觉得有用?分享给更多人

AI Agent 的非确定性行为与高速操作特性,使传统 IAM 模型失效。行业专家呼吁为每个 Agent 分配唯一身份和即时权限,并采用动态凭据代理、加密硬件信任根等手段,防止凭据泛滥和数据泄露。

SocioHack 基准测试包含 72 个模拟社会环境的沙盒,涵盖历史、合成和虚构三类场景。AI 在测试中表现良好,这提醒我们:当社会制度被编码为奖励系统时,AI 可能会学会“合规地破坏制度意图”。