Kling 视频模型上线 AI Gateway:支持 3.0、多镜头叙事与首尾帧控制

3 分钟阅读

2026 年 2 月 19 日

Kling 视频模型现已接入 AI Gateway,其中包括最新的 Kling 3.0 模型。你现在可以通过 AI Gateway 和 AI SDK,使用 Kling 的先进视频模型,从文本、图像或动作参考生成电影感视频。

Kling 模型以其图生视频能力和多镜头能力而闻名:

-

图像转视频能力:擅长将静态图片动态化为视频片段

-

真实运动与物理效果:以连贯运动、面部表情和物理交互表现见长

-

高分辨率输出:支持最高 1080p 生成(pro 模式)

-

多镜头叙事:Kling 3.0 可基于单条叙事提示词生成多场景视频

-

音频生成:可在生成视频的同时创建同步音效与环境音

-

首帧与尾帧控制:可同时指定起始帧和结束帧,实现精确场景过渡

标题链接两种上手方式

视频生成功能目前处于 beta,现已向 Pro、Enterprise 套餐以及付费 AI Gateway 用户开放。

- AI SDK 6:通过 AI SDK 6 的

generateVideo以编程方式生成视频。

import { experimental_generateVideo as generateVideo } from 'ai';const { videos } = await generateVideo({ model: 'klingai/kling-v2.6-t2v', prompt: 'A chef plates a dessert with caramel drizzle. Kitchen ambiance.',});

- Gateway Playground:在每个模型页面内嵌、可配置的 AI Gateway playground 中零代码体验视频模型。你可以对比不同 provider、调整提示词,并下载结果,无需编写代码。进入方式:在模型列表中点击任意视频生成模型。

标题链接可用模型

Model

Type

Description

klingai/kling-v3.0-t2v

Text-to-Video

最新一代,画质最佳,支持多镜头

klingai/kling-v3.0-i2v

Image-to-Video, First-and-Last-Frame

以 v3 画质进行图像动画,支持多帧控制

klingai/kling-v2.6-t2v

Text-to-Video

支持音频生成

klingai/kling-v2.6-i2v

Image-to-Video, First-and-Last-Frame

可使用图像作为参考

klingai/kling-v2.5-turbo-t2v

Text-to-Video

生成更快

klingai/kling-v2.5-turbo-i2v

Image-to-Video, First-and-Last-Frame

生成更快

标题链接简单示例:带音频的文生视频

根据文本描述生成视频。

在这个示例中,使用模型 klingai/kling-v3.0-t2v,仅凭一条简单文本提示词,生成一段樱花树视频。

import { experimental_generateVideo as generateVideo } from 'ai';const { videos } = await generateVideo({ model: 'klingai/kling-v3.0-t2v', prompt: `Cherry blossom petals falling in slow motion through golden sunlight, Japanese garden with a stone lantern, peaceful atmosphere, cinematic`, aspectRatio: '16:9', duration: 5, providerOptions: { klingai: { mode: 'pro', }, },});

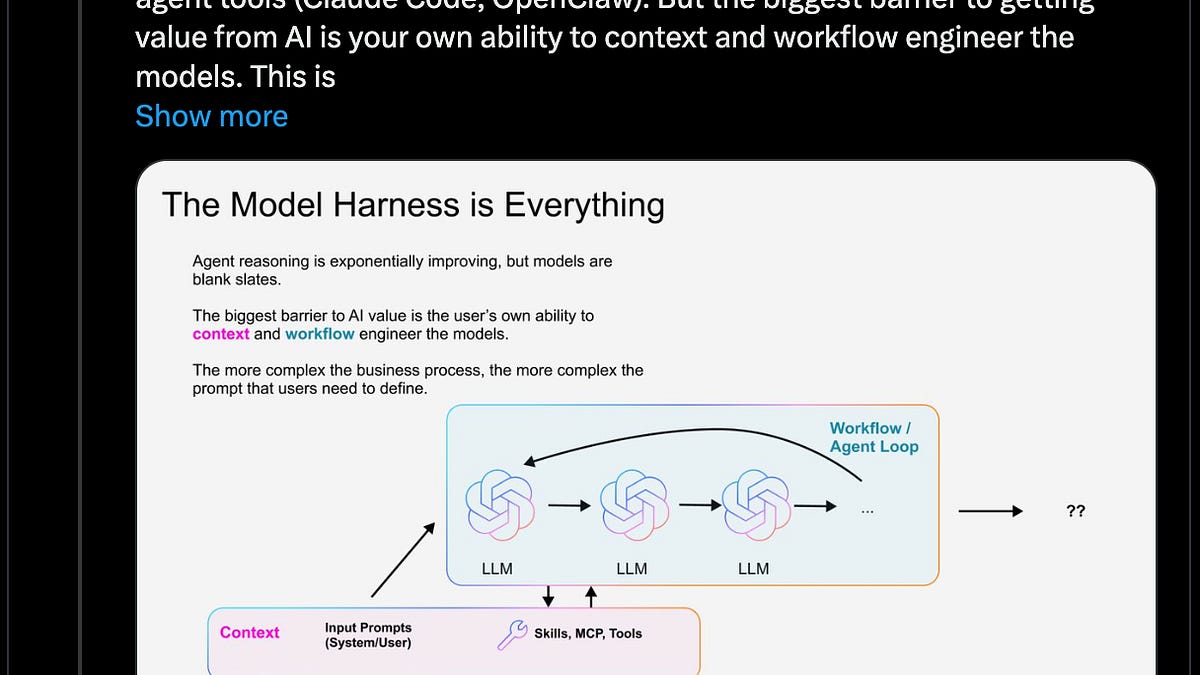

标题链接进阶:多镜头视频

只用一条提示词,生成包含多个场景的叙事视频。借助 Kling 3.0 的 multishot 功能,模型会智能切换镜头来讲述完整故事:

为了获得更好效果,提示词应写成包含多个清晰场景的叙事文本。shotType: 'intelligence' 允许模型自行决定最优镜头构图,sound: 'on' 会为整段视频生成同步音频。注意,这里的提示词放在 providerOptions 中,因为该功能是 Kling 专有。Kling 3.0 模型支持该能力:此处使用 klingai/kling-v3.0-t2v。

import { experimental_generateVideo as generateVideo } from 'ai';const { videos } = await generateVideo({ model: 'klingai/kling-v3.0-t2v', prompt: '', aspectRatio: '16:9', duration: 10, providerOptions: { klingai: { mode: 'pro', multiShot: true, shotType: 'intelligence', prompt: `Elephants walk across a golden savanna under gathering storm clouds. Lightning cracks in the distance. Rain begins to fall heavily. The herd finds shelter under acacia trees. The storm clears revealing a double rainbow.`, sound: 'on', }, },});

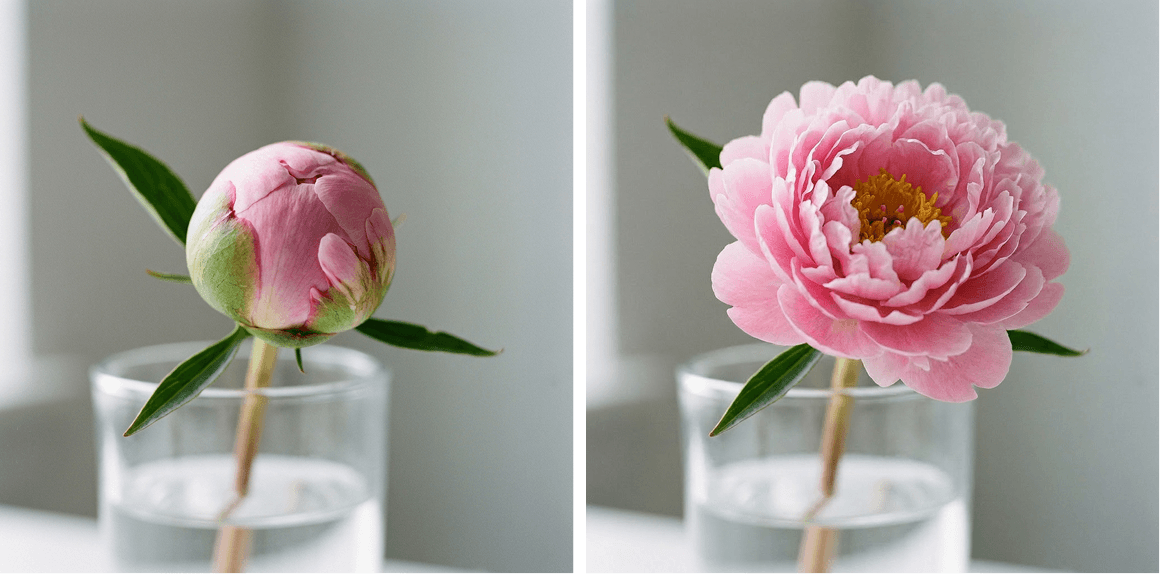

标题链接进阶:首帧与尾帧控制

通过同时提供首帧与尾帧图像,精确控制视频如何开始与结束。这非常适合做延时效果或高精度场景转场:

这里提供了 2 张图片作为起始帧和结束帧。

使用 AI SDK 6,你可以通过 image 和 lastFrameImage 分别设置起始帧和结束帧。在这个示例中,模型使用 klingai/kling-v3.0-i2v。

import { experimental_generateVideo as generateVideo } from 'ai';const { videos } = await generateVideo({ model: 'klingai/kling-v3.0-i2v', prompt: { image: startImage, text: `Time-lapse of a pink peony flower blooming. The tight bud slowly unfurls, petals gently separating and opening outward. Smooth organic movement. Soft natural lighting.`, }, duration: 10, providerOptions: { klingai: { lastFrameImage: endImage, mode: 'pro', }, },});

标题链接了解更多

如需查看更多示例和 Kling 模型的详细配置选项,请查看视频生成文档。你还可以在视频生成快速入门中找到简洁的上手脚本。

原文链接:https://vercel.com/changelog/kling-video-models-on-ai-gateway