开源模型在智能体任务上已追平闭源模型

过去几周,我们通过 Deep Agents 执行框架(Harness)对开源权重的大语言模型进行了评估,初步结果显示,它们已经可以替代或与闭源前沿模型并肩使用。GLM-5 和 MiniMax M2.7 在文件操作、工具调用和指令遵循等核心智能体任务上,得分与闭源模型相似。

如果你一直关注 SWE-Rebench 和 Terminal Bench 2.0 等开源基准测试,这个结果并不意外。工具调用可靠,指令遵循一致。对于在生产中部署智能体的开发者来说,开源模型现在提供的稳定性和可预测性,让实际工作流变得更加可行。

为什么选择开源模型

探索开源模型时,构建者和客户通常会关注几个关键因素:成本、延迟和任务性能。

理想情况下,我们希望为每个任务都使用最智能的前沿模型进行最高级别的推理。但实际上,成本和延迟这两个约束让这变得不切实际。对于高吞吐量工作负载,闭源前沿模型的成本可能高出 8-10 倍,而且对于交互式产品中用户期望的响应时间来说,它们往往太慢了。

| 模型 | 类型 | 输入($/M tokens) | 输出($/M tokens) |

|---|---|---|---|

| Claude Opus 4.6 (Anthropic) | 闭源 | $5.00 | $25.00 |

| Claude Sonnet 4.6 (Anthropic) | 闭源 | $3.00 | $15.00 |

| GPT-5.4 (OpenAI) | 闭源 | $2.50 | $15.00 |

| GLM-5 (Baseten) | 开源 | $0.95 | $3.15 |

| MiniMax M2.7 (OpenRouter) | 开源 | $0.30 | $1.20 |

举个例子:一个每天输出 1000 万 token 的应用,在 Opus 4.6 上每天成本约 250 美元,而在 MiniMax M2.7 上仅需约 12 美元。这相当于每年相差约 8.7 万美元。

开源模型通常比闭源前沿模型小,并且可以在专门的推理基础设施上加速——像 Groq、Fireworks 和 Baseten 这样的提供商在延迟和吞吐量方面的优化,远超大多数团队自己能达到的水平。OpenRouter 数据显示,Baseten 上的 GLM-5 平均延迟为 0.65 秒,每秒输出 70 个 token,而 Claude Opus 4.6 为 2.56 秒和 34 个 token/秒。对于延迟敏感的产品,这个差距很难通过工程手段弥补。

我们的评估方法

我们在《How we build evals for Deep Agents》一文中详细介绍了评估方法。我们使用托管推理提供商运行评估,但 Deep Agents 也可以通过 Ollama、vLLM 等工具使用完全本地和私有的模型运行。

对于开源模型,我们运行了七个评估类别:文件操作、工具调用、检索、对话、记忆、摘要和“单元测试”。这些涵盖了测试基础能力的任务:模型能否可靠地调用工具、遵循结构化指令、操作文件?这些能力决定了模型是否能在智能体执行框架(Harness)中使用。

每个评估案例都定义了成功断言(决定正确性的硬性检查)和效率断言(衡量模型如何达到目标的软性检查)。我们报告四个指标:

- 正确性 — 模型解决的测试比例:

passed / total。得分 0.68 意味着 68% 的测试用例被正确解决。这是主要的质量信号。 - 解决率 — 准确性和速度的综合衡量。对于每个测试,我们计算

expected_steps / wall_clock_seconds;失败的测试贡献为零。最终得分是所有测试的平均值。越高越好——既能正确又能快速解决任务的模型得分最高。 - 步骤比 — 模型实际采取的智能体步骤数与预期步骤数之比,跨所有测试汇总:

total_actual_steps / total_expected_steps。值为 1.0 意味着模型使用了预期的步骤数。高于 1.0 意味着需要更多步骤(效率较低);低于 1.0 意味着需要的步骤比最初预期的少。 - 工具调用比 — 与步骤比概念相同,但计算的是单个工具调用而不是步骤。1.0 是按预算,高于是超预算,低于是低于预算。

步骤比和工具调用比是效率指标。它们不影响测试是否通过,但揭示了模型达到答案的经济性。一个用 2 步而不是预期的 5 步解决任务的模型,既正确又高效。

评估结果

这些是早期结果;我们正在积极维护和扩展我们的评估集。你可以实时查看最近的运行结果,包括我们的 GitHub 仓库和这个共享的 LangSmith 项目。

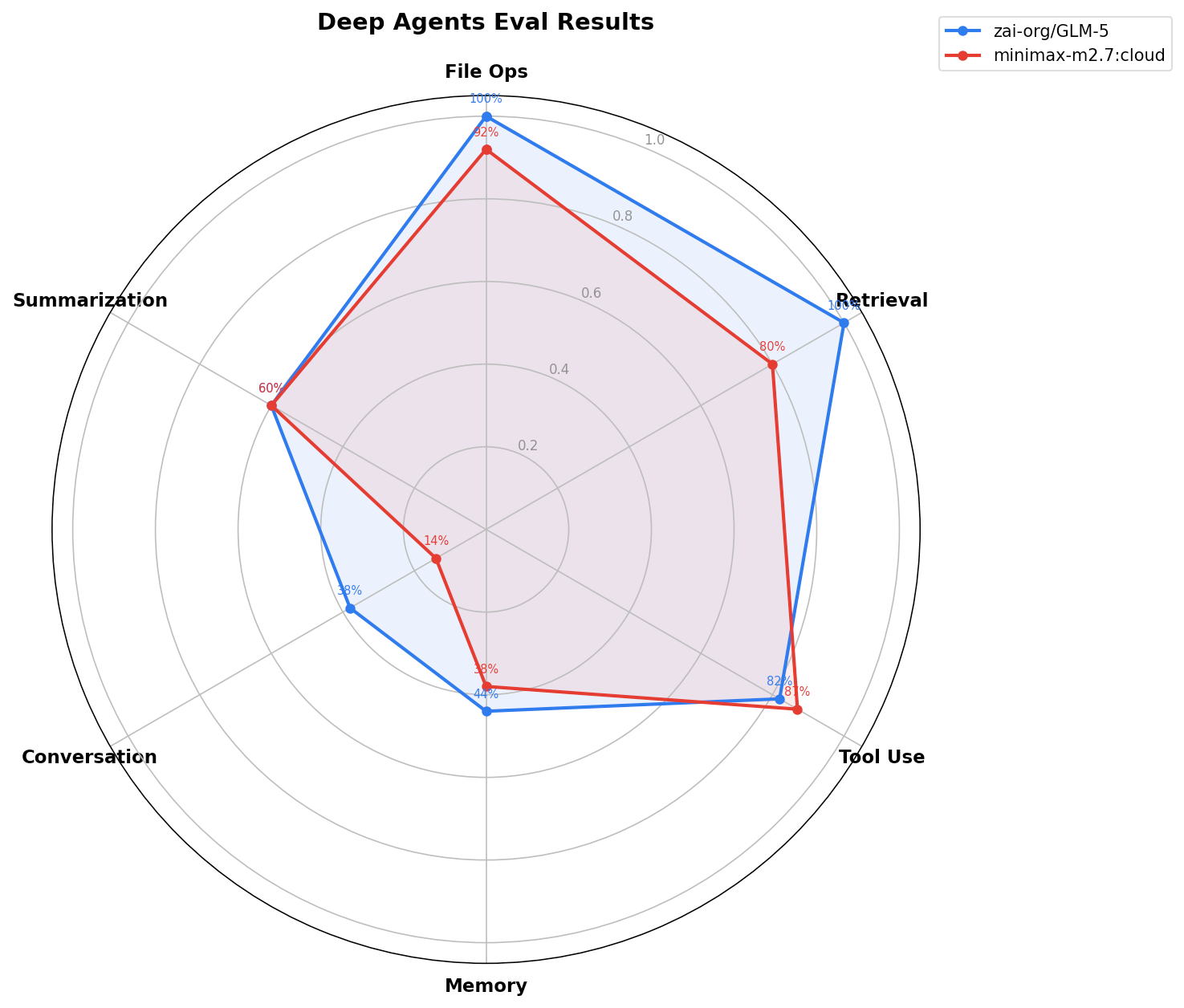

开源模型

查看 CI 运行(点击模型名称查看单个评估)

| 模型 | 正确性 | 通过数 | 解决率 | 步骤比 | 工具调用比 |

|---|---|---|---|---|---|

| baseten:zai-org/GLM-5 | 0.64 | 94 of 138 | 1.17 | 1.02 | 1.06 |

| ollama:minimax-m2.7 | 0.57 | 85 of 138 | 0.27 | 1.02 | 1.04 |

按类别正确性:

| 模型 | 对话 | 文件操作 | 记忆 | 检索 | 摘要 | 工具调用 | 单元测试 |

|---|---|---|---|---|---|---|---|

| baseten:zai-org/GLM-5 | 0.38 | 1 | 0.44 | 1 | 0.6 | 0.82 | 1 |

| ollama:minimax-m2.7:cloud | 0.14 | 0.92 | 0.38 | 0.8 | 0.6 | 0.87 | 0.92 |

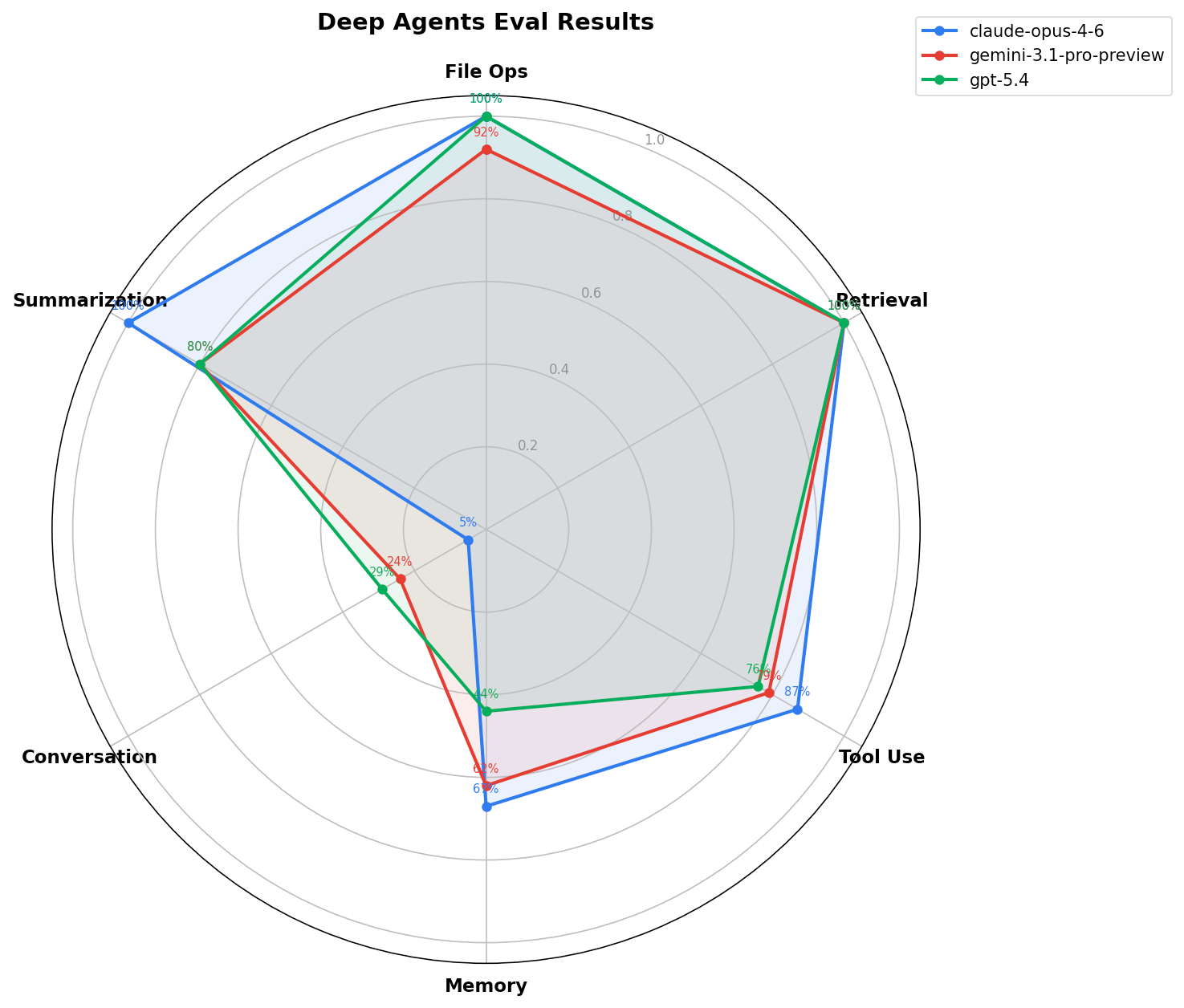

前沿模型

查看 CI 运行(点击模型名称查看单个评估)

| 模型 | 正确性 | 通过数 | 解决率 | 步骤比 | 工具调用比 |

|---|---|---|---|---|---|

| anthropic:claude-opus-4-6 | 0.68 | 100 of 138 | 0.38 | 0.99 | 1.02 |

| google_genai:gemini-3.1-pro-preview | 0.65 | 96 of 138 | 0.26 | 0.99 | 1.01 |

| openai:gpt-5.4 | 0.61 | 91 of 138 | 0.61 | 1.05 | 1.15 |

按类别正确性:

| 模型 | 对话 | 文件操作 | 记忆 | 检索 | 摘要 | 工具调用 | 单元测试 |

|---|---|---|---|---|---|---|---|

| anthropic:claude-opus-4-6 | 0.05 | 1 | 0.67 | 1 | 1 | 0.87 | 1 |

| google_genai:gemini-3.1-pro-preview | 0.24 | 0.92 | 0.62 | 1 | 0.8 | 0.79 | 0.92 |

| openai:gpt-5.4 | 0.29 | 1 | 0.44 | 1 | 0.8 | 0.76 | 1 |

对于每个模型,我们选择使用提供商的默认思考级别。

对于 Gemini 3+,这是 high

对于 OpenAI,这是 medium

对于 Claude,这是没有扩展思考的版本

自己动手:本地运行 Deep Agent 评估

我们的 CI 在 52 个模型组成的组中运行相同的评估套件——包括一个 open 组(baseten:zai-org/GLM-5、ollama:minimax-m2.7:cloud、ollama:nemotron-3-super),它在每个评估工作流中运行。你可以针对任何模型组:

运行针对所有开源模型的评估:pytest tests/evals --model-group open

运行针对特定模型的评估:pytest tests/evals --model baseten:zai-org/GLM-5

这使得在同一任务上、使用相同的评分标准,比较开源模型之间以及开源模型与闭源前沿模型变得简单直接。

在 Deep Agents SDK 中使用开源模型

切换到开源模型只需一行代码:

GLM-5:

# pip install langchain-baseten

from deepagents import create_deep_agent

agent = create_deep_agent(model="baseten:zai-org/GLM-5")

MiniMax M2.7:

# pip install langchain-openrouter

from deepagents import create_deep_agent

agent = create_deep_agent(model="openrouter:minimax/minimax-m2.7")

就这样。执行框架(Harness)会处理其余的事情——它检测模型的上下文窗口大小,禁用不支持的模式,并将正确的身份注入系统提示中,以便智能体知道自己在处理什么。

同一个开源模型通常可以通过多个提供商获得。选择符合你约束条件的那个。例如,GLM-5 可以作为 baseten:zai-org/GLM-5、fireworks:fireworks/glm-5 或用于自托管的 ollama:glm-5 使用。相同的模型,相同的执行框架,不同的基础设施。

LangChain 为最流行的开源模型提供商提供支持。我们为此版本测试的提供商包括:Baseten、Fireworks、Groq、OpenRouter 和 Ollama(云)。

为你的模型调整执行框架级别

开源模型与闭源前沿模型有不同的上下文窗口、不同的工具调用格式和不同的失败模式。Deep Agents 执行框架吸收了这些差异,所以你不需要处理:

- 模型身份注入 — 系统提示在运行时被修补,包含模型的名称、提供商、上下文限制和支持的模式。智能体知道它是什么以及它能做什么。

- 上下文管理 — 压缩、卸载和摘要阈值会根据模型的实际上下文窗口进行调整,而不是硬编码的默认值。一个拥有 4K 上下文的模型会比拥有 1M 上下文的 Opus 获得更积极的压缩。

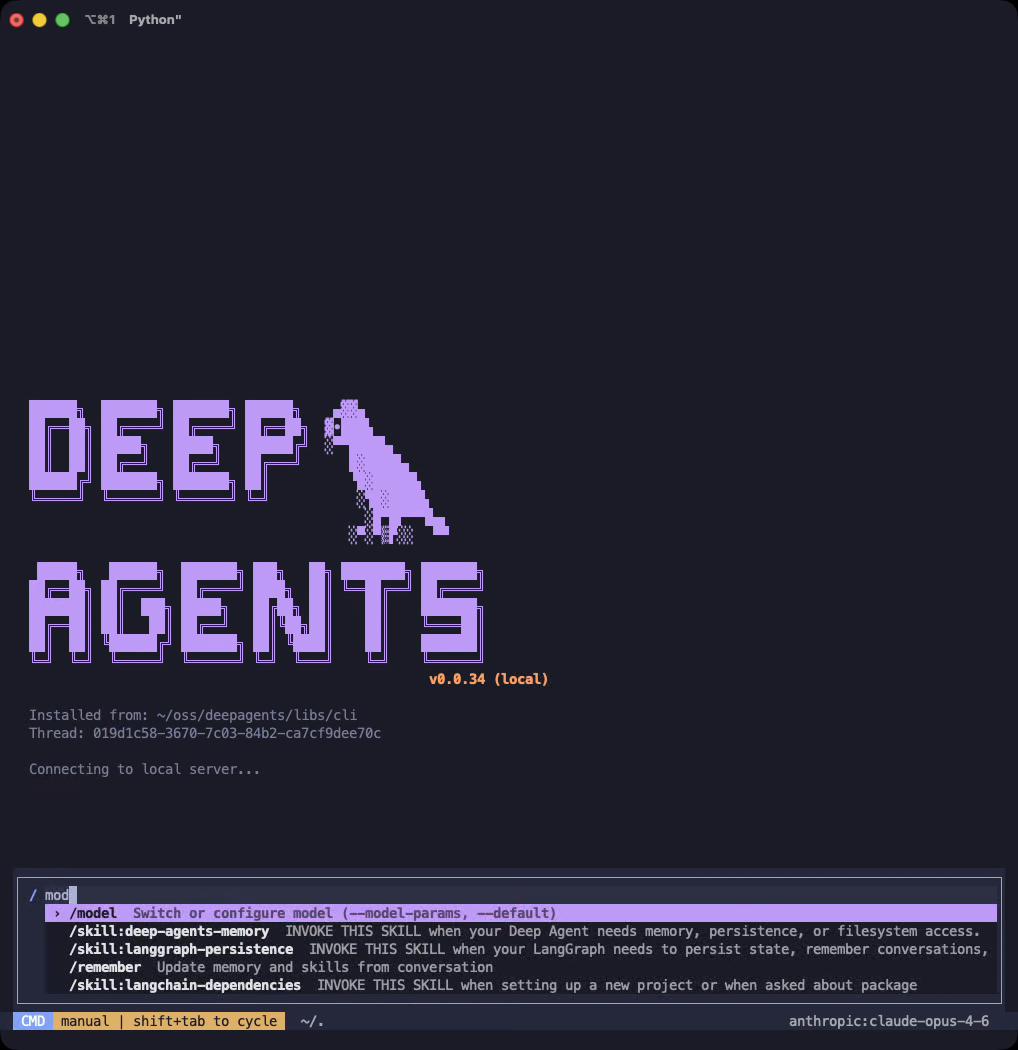

Deep Agents CLI

每个模型也可以在 Deep Agents CLI 中使用。Deep Agents CLI 是我们的开源编码智能体,也是 Claude Code 的替代品。

除了 Deep Agents SDK 中的所有功能外,CLI 还支持运行时模型切换。我们引入了一个新的中间件(ConfigurableModelMiddleware)来实现在不重启智能体的情况下在会话中切换模型。这使得像使用前沿模型进行规划,然后切换到更便宜的开源模型进行执行的模式成为可能。

你可以使用 /model 斜杠命令在会话中切换模型。这使得像使用前沿模型开始任务进行规划,然后切换到更便宜的开源模型进行执行的模式成为可能。

0:00

/0:50

下一步计划

我们期待很快分享的一些事情:

- 记录针对特定开源模型系列的执行框架调优模式

- 测试多模型子智能体配置(例如:前沿闭源模型编排器 + 开源模型子智能体)

开源模型现在就可以用于智能体。我们想展示帮助我们设计良好执行框架的设计模式,并构建有针对性的评估来衡量对你的任务重要的指标。

Deep Agents 是开源的。用你喜欢的开源模型试试,和我们一起构建出色的评估和智能体。

觉得有用?分享给更多人