Anthropic 推出 Claude Cowork 应对 OpenClaw

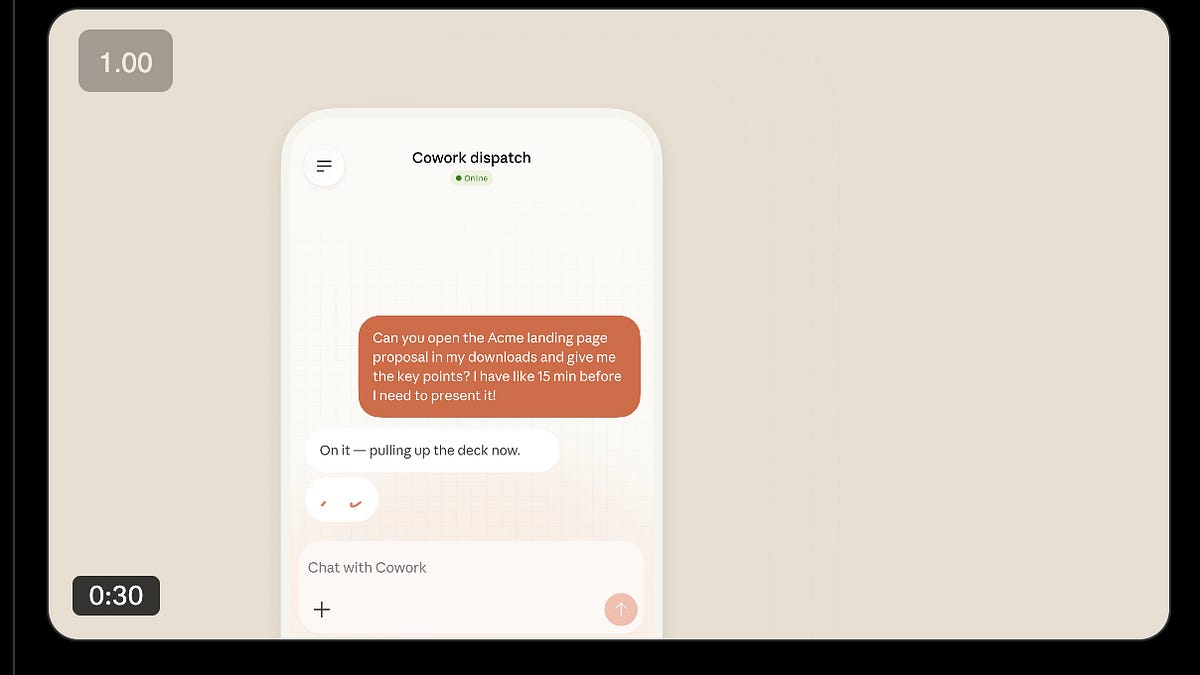

今天的主播嘉宾 Felix 恰好也带来了头条新闻:Claude Cowork 终于来了。从 Simon Willison 到 Ethan Mollick,多位开发者都将其与 OpenClaw 相提并论,并给出了积极评价。正如 Jensen 昨天所说,每家公司都需要一个 OpenClaw 策略。现在,曾与 Clawdbot 关系“失手”的 Anthropic 给出了自己的答案,而且看起来相当不错。

想了解完整的故事起源、用例和设计思路(特别是关于沙盒化和 Electron 的技术选择),可以收听今天的播客节目。

OpenAI 发布 GPT-5.4 Mini/Nano:转向小型、编码优化模型

- GPT-5.4 mini 和 nano 已在 API、ChatGPT 和 Codex 上线:OpenAI 发布了 GPT-5.4 mini 和 GPT-5.4 nano,定位为目前能力最强的小型模型。根据 @OpenAIDevs 的说法,GPT-5.4 mini 比 GPT-5 mini 快 2 倍以上,目标场景包括编码、计算机使用、多模态理解和子智能体,并在 API 中提供 40 万 token 的上下文窗口。OpenAI 还声称,在包括 SWE-Bench Pro 和 OSWorld-Verified 在内的评估中,mini 的性能接近更大的 GPT-5.4,同时仅消耗 GPT-5.4 Codex 配额的 30%,使其成为许多后台编码工作流和子智能体扇出的新默认选择。

- 早期反响聚焦编码价值,但也关注定价与真实性权衡:开发者们立即指出了 mini 在 Codex 子智能体、计算机使用工作负载以及外部产品(如 Windsurf)中的实用性。然而,评论也集中在一个熟悉的 OpenAI 模式上:性能更好,但价格更高。@scaling01 的帖子指出,mini 的定价为输入 0.75 美元/百万 token,输出 4.5 美元/百万 token,nano 的定价也高于之前的 nano 层级。第三方评估结果不一:Mercor 的 APEX-Agents 结果显示,mini 在 xhigh reasoning 设置下取得了 24.5% 的 Pass@1,在该基准测试中领先于一些轻量级和中量级竞争对手;而 BullshitBench 则显示,这些新的小型模型在抵抗虚假前提/术语陷阱方面排名相对较低。OpenAI 也悄然承认了行为调优问题,@michpokrass 表示最近的一次 5.3 instant 更新减少了“烦人的点击诱饵式”行为。

智能体基础设施:沙盒、子智能体、Open SWE 与执行框架之争

- 代码执行智能体正成为产品架构的核心:几项发布表明,围绕安全执行、编排和部署体验的堆栈正在成熟,而不仅仅是基础模型的改进。LangChain 推出了 LangSmith 沙盒,用于安全的临时代码执行。@hwchase17 明确主张“越来越多的智能体将编写和执行代码”。与此同时,LangChain 开源了 Open SWE,这是一个后台编码智能体,其模式据称在 Stripe、Ramp 和 Coinbase 内部使用。该系统集成了 Slack、Linear 和 GitHub,使用子智能体加中间件,并分离了执行框架、沙盒、调用层和验证。这是从“聊天副驾驶”迈向可部署的内部工程智能体的重要一步。

- 子智能体和安全执行现已成为整个生态系统的首要产品特性:OpenAI 的 Codex 现已支持子智能体,而 GPT-5.4 mini 也被 OpenAI 定位为特别适合此用例。Hermes Agent 的 v0.3.0 发布是另一个强烈信号:5 天内合并了 248 个 PR,提供一流的插件架构、通过 CDP 实现的实时 Chrome 控制、IDE 集成、基于本地 Whisper 的语音模式、PII 脱敏以及如 Browser Use 等提供商集成。由此产生的方向在各厂商间是一致的:智能体的价值越来越依赖于安全执行环境、可组合的技能/插件以及工作流原生的界面,而不仅仅是原始基准测试的提升。

架构研究:注意力残差、垂直注意力与 Mamba-3

- 跨层注意力正成为热点:Moonshot 的注意力残差论文引发了围绕“垂直注意力”或跨层注意力的实质性技术讨论。@ZhihuFrontier 的详细解读将该思想描述为每一层查询前一层状态,有效地将注意力从水平序列交互扩展到层间记忆。社区反应强调这并非孤立现象:@rosinality 指出字节跳动也实现了跨层注意力,@arjunkocher 则发布了实现教程。这里有趣的计算系统论点是,由于层数远小于序列长度,某些形式的垂直注意力可能隐藏在现有计算之下,并且几乎不增加额外延迟。

- Mamba-3 强化了推理优先混合架构的案例:另一个主要的架构发布是 Mamba-3,由 @_albertgu 和 @tri_dao 呈现,作为使线性/状态空间模型在混合时代更具竞争力的最新一步。其重点明确在于推理效率,而非完全取代 Transformer。Together 将其总结为一种 MIMO 变体,能在相似的解码速度下提升模型强度,并声称在 1.5B 参数规模下,其性能在同类线性模型中领先,且预填充和解码速度最快。Tri Dao 还指出,推理密集的强化学习和长序列生成工作负载是此类架构特别肥沃的土壤。从注意力残差和 Mamba-3 中得到的更广泛启示是,实验室仍在寻找方法,以在不牺牲太多生态系统兼容性的前提下,缓解全 Transformer 的瓶颈。

GTC:NVIDIA 的智能体推动、开源模型与基础设施论题

- GTC 的核心信息围绕推理、智能体和“token 工厂”世界观:多篇帖子反映了 Jensen Huang 对未来计算机作为 “制造 token” 系统的定位,推理现在正驱动下一波容量需求。这体现在产品和生态系统公告中:LangChain 表示其框架下载量突破 10 亿次,并加入了 NVIDIA Nemotron 联盟;@ggerganov 强调了 llama.cpp 对 Nemotron 3 Nano 4B 的支持;Hugging Face 的 @jeffboudier 则回顾了一系列 NVIDIA 的开源发布,涵盖推理模型、机器人数据集和世界模型。

- 开源和企业级智能体工具主导了周边公告:H Company 发布了 Holotron-12B,这是一个与 NVIDIA 合作构建的、用于计算机使用智能体的开源多模态模型。Perplexity 宣布了 Comet Enterprise,将其 AI 浏览器引入企业团队,并提供部署控制和 CrowdStrike Falcon 集成。NVIDIA 更广泛的商业论题也得到了放大:@TheTuringPost 强调了 Jensen 的评论,即常被引用的 1 万亿美元 AI 基础设施机会 仅涵盖了到 2027 年堆栈的一部分,这强化了行业在推理基础设施建设方面仍处于非常早期的阶段。

开源工具、本地智能体与开发者堆栈升级

(此为多部分文章的第一部分,后续内容待续。)

本地和私有智能体工作流也在持续进化。Hugging Face 发布了一个 hf CLI 扩展,能自动检测可用硬件的最佳本地模型和量化版本,并启动一个本地编码智能体。Unsloth 推出了开源 Web UI Unsloth Studio,用于在 Mac/Windows/Linux 上本地训练和运行 500 多个模型,宣称能实现 2 倍训练速度提升,同时减少 70% 的 VRAM 占用,支持 GGUF、合成数据工具、工具调用和代码执行。Ollama 则为 OpenClaw 工作流增加了 网络搜索/获取插件和无头启动支持,同时也在 CodexBar 中作为提供商出现。

开放的编码智能体生态正在变得清晰

模式正在趋于统一:模型无关的执行框架(Harness)、结构化技能(Skills)、文件系统/状态抽象,以及临时的云端或本地执行。LangChain 的 Deep Agents 被描述为一个采用 MIT 许可证、可检查的 Claude Code 风格智能体执行框架(Harness)的复刻版。Hermes Agent 的插件系统和对本地模型的友好性也让它进入了同一讨论范畴。这是数据集中一个比较清晰的趋势:前沿领域不再仅仅是开放权重的模型,还包括用于实际部署智能体的开放执行框架(Harness)和运行时层。

热门推文(按互动量)

- OpenAI 小模型发布:@OpenAIDevs 关于 GPT-5.4 mini/nano 的推文是当天最重要的技术公告之一,尤其对于编码智能体工作负载。

- Cursor 基于强化学习的上下文压缩:@cursor_ai 称其训练了 Composer 通过强化学习而非提示(Prompting)进行自我总结,将压缩错误率降低了 50%,从而能够处理更复杂的长期编码任务。

- Mamba-3 发布:@_albertgu 和 @tri_dao 的推文标志着本周期序列建模领域最重要的架构更新之一。

- Unsloth Studio:@UnslothAI 的发布是当天最强劲的开源产品发布之一,目标直指本地训练/推理实践者。

- Kimi Attention Residuals:@Kimi_Moonshot 的推文引发了大量关于架构的讨论,后续分析围绕垂直注意力(Vertical Attention)和层间记忆展开。

社区热议

-

Unsloth 宣布 Unsloth Studio - LMStudio 的竞争对手? (热度:998) Unsloth Studio 作为一个新的开源、无代码 Web 界面发布,用于本地训练和运行 AI 模型,可能挑战 LMStudio 在 GGUF 生态中的主导地位。它兼容

Llama.cpp,并提供自动修复工具调用、Python 和 bash 代码执行、以及支持音频、视觉和大语言模型微调等功能。该平台支持 GGUFs,可在 Mac、Windows 和 Linux 上运行,具备 SVG 渲染、合成数据生成和快速并行数据准备能力。安装很简单,通过pip install unsloth即可。更多详情可查阅 Unsloth 文档。 一些用户质疑将 LMStudio 描述为高级用户的“首选”是否准确,并提到了 vLLM 或 llama.cpp 等替代方案。另一些用户则对 UI 的功能,特别是训练和数据准备能力感到兴奋。- danielhanchen 强调了 Unsloth Studio 的广泛功能集,包括自动修复工具调用、Python 和 bash 代码执行、以及对 Mac、Windows 和 Linux 等多操作系统的支持。该工具还提供 SVG 渲染、合成数据生成和快速并行数据准备等高级功能,使其成为适用于各种 AI 任务的综合解决方案。更多详情和安装说明可在 GitHub 上找到。

- sean_hash 指出,像 Unsloth Studio 这样将微调和推理功能集成到一个工具中非常方便。这与当前需要多个项目才能实现相同功能的情况形成对比,凸显了 Unsloth Studio 在简化 AI 开发工作流方面的潜力。

- Specter_Origin 赞赏 Unsloth Studio 的开源性质,这与闭源的 LM Studio 形成对比。这种开放性对于偏好透明度并能根据需求修改工具的开发者来说可能是一个显著优势。

-

介绍 Unsloth Studio:一个用于训练和运行大语言模型的新开源 Web UI (热度:579) Unsloth Studio 是一个新的开源 Web UI,旨在 Mac、Windows 和 Linux 上本地训练和运行大语言模型。它宣称能以两倍速度训练超过

500+ 模型,同时使用70% 更少的 VRAM。该平台支持 GGUF、视觉、音频和向量嵌入(Embedding)模型,并包含模型比较、自我修复工具调用和网络搜索等功能。它还提供从 PDF、CSV 和 DOCX 等格式自动创建数据集的能力,并允许执行代码以提高大语言模型输出的准确性。模型可以导出为 GGUF 和 Safetensors 等格式,并自动调整推理参数。安装可通过pip install unsloth完成。更多详情可访问 GitHub 和 文档。 评论者对 Unsloth Studio 作为现有平台的一个完全开源替代品感到兴奋,强调了它对于微调模型的可访问性,特别是对于专业知识较少的用户。社区对即将到来的 AMD 支持充满期待,预计这将扩大其可用性。- 一位用户强调了让微调变得可访问的重要性,指出 Unsloth Studio 提供了一种简单的方法来微调模型,这自 LLaMA 2 发布以来一直是个挑战。这种可访问性可能复兴“微调的黄金时代”,让专业知识较少的人更容易参与模型定制。

- 另一位用户指出了安装过程中遇到的一个技术问题:在下载大型

torch包时因磁盘空间不足而出现 OSError。这凸显了 AI/ML 项目中管理依赖和系统资源的常见挑战,表明可能需要组件的原子化安装来降低入门门槛。 - 一位 AMD 代表表示已准备好支持 Unsloth Studio 即将到来的官方 AMD 支持,这表明对于 AMD 硬件用户来说,兼容性和性能可能会有潜在提升。这种合作可以增强 Unsloth Studio 在不同硬件平台上的可用性。

-

Qwen3.5-9B 在文档基准测试中的表现:哪些地方超越了前沿模型,哪些地方没有。 (热度:295) 图片比较了阿里巴巴的 Qwen3.5-9B 和 OpenAI 的 GPT-5.4 在文档 AI 基准测试中的表现。Qwen3.5-9B 以

77.0分排名第 9,在“关键信息提取”和“表格理解”方面表现出色,而 GPT-5.4 以81.0分排名第 4,在其他领域领先。基准测试结果突显了 Qwen3.5-9B 在“OmniOCR”方面的卓越性能,但在“OmniDoc”和“IDP Core”方面落后。这与帖子中的详细分析一致,即 Qwen 模型在 OCR 和 VQA 任务上表现优异,但在表格提取和手写体 OCR 方面落后。 一位评论者认为 AI 技术正在达到功能上限,表明当前模型对于许多任务已经足够,并且可以在性能较低的硬件上高效运行。另一位评论者期待与 GLM-OCR 的有趣比较,第三位则注意到使用较小的 Qwen 模型处理能容忍更长处理时间的任务时可能具有的能效优势。- Qwen3.5-9B 的性能:该模型在与更大的前沿模型竞争中表现出色,特别是在文档处理任务中。它能在超极本等低端硬件上高效运行,突显了其能效和更广泛应用的潜力。这表明了一种趋势:针对特定任务优化较小的模型,而不仅仅依赖更大、更耗资源的模型。

- 能效与推理:Qwen3.5-9B 模型因其能效而受到关注,尤其是在需要长时间推理的任务中。与 Gemini 或 GPT 等更大模型相比,如果处理时间不是关键因素,Qwen3.5-9B 提供了一个更可持续的选择。这使其成为能源消耗优先的应用场景中的一个可行替代方案。

- 模型变体与基准测试:社区对 Qwen 更大模型变体(如 27B 密集模型和 35B MoE 模型)在基准测试中的缺席感到好奇。这种缺席引发了关于这些更大模型在特定任务中的比较性能和潜在优势的问题,表明需要对这些变体进行进一步的探索和基准测试。

Mistral Small 4 来了,1190 亿参数、256k 上下文长度,还支持多模态输入。但网友调侃:现在 1200 亿参数都算“小”模型了。

这个混合 AI 模型整合了 Instruct、Reasoning 和 Devstral 三个系列的能力,采用专家混合(MoE)架构,有 128 个专家,每次激活 65 亿参数。它支持配置推理强度,能在快速响应和深度思考之间切换,还自带函数调用和 JSON 输出功能。Apache 2.0 许可证,商用免费。

不过,社区讨论焦点在于参数激活量。Mistral Small 4 激活 65 亿参数,而竞品 Qwen3.5-122B-A10B 激活 100 亿参数——这可能解释了为什么 Mistral 整体表现没超过 Qwen3.5。参数激活量对模型性能影响很大。

另一个热议点是工具调用能力。之前 Devstral 2 版本存在严重问题:会伪造函数签名、在多步链中丢失参数。大家关心 Mistral Small 4 是否修复了这些缺陷,毕竟在 6-7B 激活参数这个档位,文本和代码质量对本地部署至关重要。

还有人对超长上下文质量表示怀疑。虽然广告说支持 256k,但小规模 MoE 模型经常在超过 32k 后表现下滑。实际效果有待验证。

好消息是,llama.cpp 已经在集成 Mistral 4 了,GitHub 上能看到 PR。这意味着很快就能用这个流行框架高效运行新模型。

另一边,NVIDIA DGX Station 工作站开始通过 OEM 分销商出货了。

这台“梦想机器”专为 AI 和深度学习设计,搭载最新 NVIDIA 技术,价格在 8.5-9 万美元区间。有趣的是,它没有视频输出接口——除非额外加装显卡。这明确体现了它的定位:纯计算工具,不是给普通消费者用的。

讨论中还提到了“一致性内存”(Coherent Memory)概念。用户猜测这可能让 GPU 直接访问全部内存,类似 DGX Spark 的设计。如果属实,对处理大数据集和高负载任务会是重大利好。

不过,Dell 的产品列表似乎有些混乱,价格和配置信息对不上。大家还在观望实际供货情况。

NVIDIA 自家也放了个大招:Nemotron 3 Ultra Base 模型,约 5000 亿参数。

宣传幻灯片称它是“最佳开源基础模型”,效率提升 5 倍,推理准确率高。柱状图对比了 Nemotron 3 Ultra 与 GLM、Kimi K2 等模型在多项基准测试中的表现,包括峰值吞吐量、MMLU Pro 理解、HumanEval 代码、GSM8K 数学和多语言 MMLU。

但社区反应很谨慎。

网友指出,NVIDIA 没说明对比的是哪个 GLM 模型。而 Kimi K2 已经是八个月前的老模型了,如果指的是基础版,智能水平大概相当于 MiniMax M2.1 和 GLM-5-no-reasoning。

更关键的是,基础模型和微调版本差别巨大。幻灯片里对比的可能是 Kimi K2 Base 1T 和 GLM 4.5 355B Base,而不是更先进的 K2.5 或 GLM 5(这些是指令/推理微调版)。这种比较容易误导人。

还有个小技巧被发现了:柱状图从 60% 开始,放大了性能差距。这种 presentation 手法在技术圈不太受欢迎。

相关社区动态:/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding, /r/aivideo, /r/aivideo

LTX 2.3 LORA 模型展示真实能力

Reddit 用户分享了一个基于 LTX 2.3 训练的 LORA 模型,专门用于生成游戏《Dispatch》的角色和风格。这个模型训练了大约 440 个游戏片段,每个片段平均 121 帧,涵盖了超过 6 个拥有独特声音和风格的角色。实现方法是给每个角色分配一个独特的触发词和详细的描述文本。

技术栈用的是 musubi fork by akanetendo25。处理流程包括用 pyscene 分割片段,转换成 24 fps,并使用一个自定义的标注工具生成描述。数据集根据片段长度分成了高清(HD)和标清(SD)两组。训练过程消耗了 31GB VRAM,使用了 4 blockswap,模型秩(rank)设为 64 以处理数据的复杂性,每 500 步保存一次检查点。

作者提到,LTX 虽然在视觉上不如 WAN 那么强,但在游戏开发的预可视化方面潜力很大。评论区里,有人对 WAN 2.5 是否开源表示怀疑,也有人对用 440 个片段训练的投入表示敬佩,认为效果很干净。

- Lars-Krimi-8730 询问了训练的技术细节,比如用了什么训练器、具体设置、标注方法和分辨率。这表明大家对如何复现这个训练过程很感兴趣。

- Anxious_Sample_6163 特别指出了 440 个片段这个数据量,认为这体现了巨大的投入和努力,这么扎实的数据集很可能就是模型效果好、输出干净的原因。

- SvenVargHimmel 问在

5090GPU 上训练了多久,这关系到计算资源和时间成本,对评估类似项目的可行性和扩展性很重要。

复刻千禧年手机质感:OldNokia UltraReal LoRA

另一个帖子介绍了一个重新训练的 LoRA 模型,名叫 OldNokia UltraReal,目标是复现 2000 年代中期手机摄像头的美学。它的特点包括软焦塑料镜头效果、褪色的色彩风格,以及 JPEG 压缩和色度噪点等数字伪影。模型是基于作者自己的诺基亚 E61i 照片档案训练的。

模型可以在 Civitai 和 Hugging Face 下载。有评论开玩笑说,历史上的诺基亚相机动态范围其实没模型里这么好。还有人建议用 qwen-image 进一步训练来增强效果,另一位则表达了对这个 LoRA 的热情,并分享了自己一个涉及帧注入的个人项目。

- jigendaisuke81 建议用

qwen-image训练模型,可能是想探索模型在不同数据集或架构下的表现,看看能不能进一步提升图像生成能力。 - Striking-Long-2960 提到了对‘在 Wan2GP 中进行帧注入’的兴趣,这听起来像是一种技术探索,想把帧序列整合进生成模型,可能用于视频或动画制作。

- berlinbaer 强调了 LoRA 模型在复现特定视觉效果上的技术成就,比如‘高光溢出及其蓝红色移’。这说明模型在模仿复杂摄影效果方面做得不错,而这些效果单靠简单提示词可能很难实现。

Anthropic CEO 预测:三年内半数初级白领工作将消失

Anthropic 的首席执行官预测,由于 AI 技术的进步,未来三年内将有 50% 的初级白领岗位被淘汰。这个说法凸显了 AI 在工作场所的快速整合,可能会取代传统上由人类完成的任务,即使像 copilot 这样的 AI 解决方案在质量和准确性上可能还比不上人类专家。

这个预测指向了就业市场的重大转变,强调了劳动力需要适应和技能升级。一条高赞评论分享了一个亲身经历:AI 被用来执行不擅长的工作,导致错误和错误结论。这反映了一个更广泛的担忧:在专业场景中过早依赖 AI,可能会损害人类专业知识和职业安全。

- Due_Answer_4230 指出了 AI 融入工作场所的一个实际问题:像 Copilot 这样的 AI 工具被用来取代人力,即使它们表现很差。这会导致错误和错误结论,但管理层可能因为速度而偏爱 AI,这让那些投入多年时间培养专业技能的员工处境艰难。

- Stahlboden 提到了一年前的一个预测,说 AI 将编写 100% 的代码。虽然这还没完全实现,但 AI 在编码中的作用确实大大增加了。这反映了 AI 在技术领域能力增长的大趋势,暗示未来 AI 可能在某些任务上占据主导。

- Environmental_Dog331 指出,AI 领域的领导者们对于 AI 进步导致的岗位流失,并没有提出什么解决方案。这条评论强调了挑战所在:创造新岗位的速度很难跟上 AI 导致的岗位流失,这是劳动力转型战略规划中的一个关键缺口。

NBC 调查:美国人对 AI 的厌恶超过 ICE

NBC 新闻的一项调查显示,只有 26% 的选民对 AI 持正面看法,而 46% 持负面看法。这使得 AI 的受欢迎程度低于大多数话题,仅高于民主党和伊朗。这反映了对 AI 更广泛的怀疑态度,尽管它已被广泛使用并具有作为生产力工具的潜力。

调查凸显了 AI 的感知能力与其实际效用之间的脱节,尤其是在替代需要大量行业知识的工作方面。评论者指出了一个悖论:经常使用 AI 的人仍然因为 AI 能力被过度炒作(尤其是其替代白领工作的潜力)而心怀不满。共识是,虽然 AI 是个强大的工具,但它目前还无法替代需要深厚行业知识的工作。

- TimeTravelingChris 强调了 AI 潜力与实际应用之间的差距,指出虽然 AI 可以成为强大的生产力工具,但它目前还无法替代需要大量行业和公司知识的工作。评论者强调验证 AI 输出的重要性,因为这项技术在仔细审视下仍有明显缺陷。

- AlexWorkGuru 讨论了实验室展示的 AI 潜力与用户日常体验之间的差异,后者常常是与聊天机器人和自动电话系统等基础 AI 实现的 frustrating 交互。这种差距导致了 AI 的可信度问题,因为推广 AI 的公司往往是用户本就不信任的那些,这加剧了负面看法。

- bjxxjj 指出,公众对 AI 的看法很大程度上受到负面关联的影响,比如裁员和监控,而不是像教育聊天机器人这样的实际应用。这表明关于 AI 情绪的调查结果,可能会因为受访者考虑的是 AI 的特定方面而产生偏差。

结语

很遗憾,我们的 Discord 访问权限今天被关闭了。我们不会以这种形式恢复它,但新的 AINews 即将推出。感谢阅读到这里,这是一段不错的旅程。

觉得有用?分享给更多人