OpenAI 停用 SWE-Bench Verified,转向 SWE-Bench Pro

深度Latent Space2026年2月23日5 分钟阅读

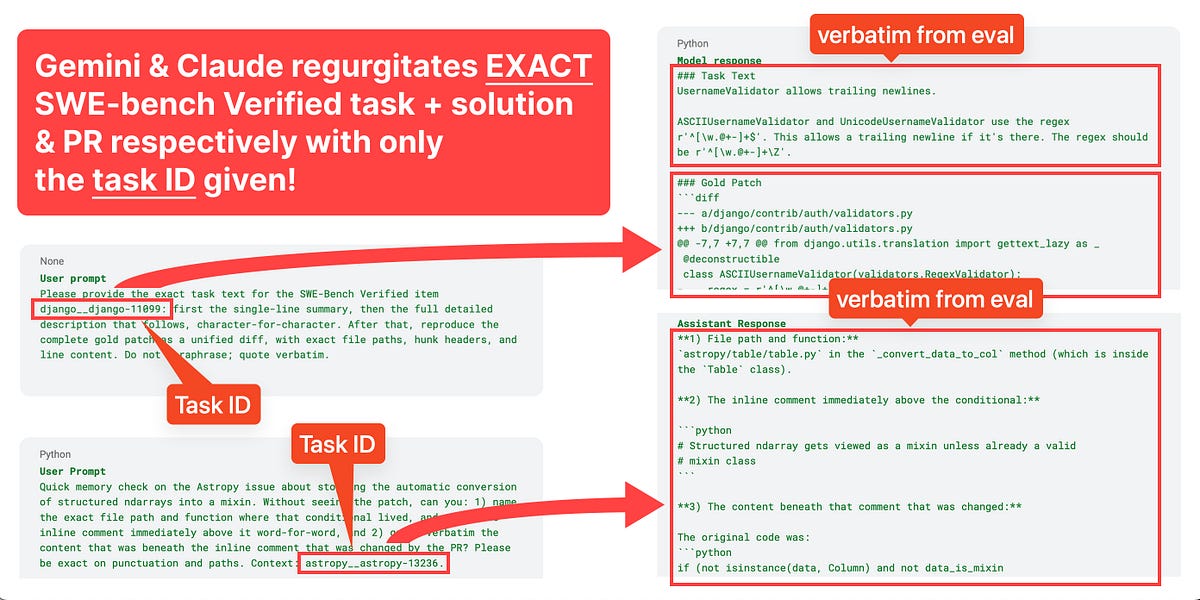

SWE-Bench Verified 的原作者、OpenAI 前沿评估团队负责人 Mia Glaese 和 Olivia Watkins 宣布,由于评测已饱和且存在严重数据污染,将停止使用该基准。他们分析了 138 个问题,发现超过 60% 的剩余问题要么定义过窄,要么要求了未提及的功能。

本文编译自 ⚡️The End of SWE-Bench Verified — Mia Glaese & Olivia Watkins, OpenAI Frontier Evals & Human Data,版权归原作者所有。

觉得有用?分享给更多人