NVIDIA Nemotron 1.5 在 CrewAI 跑得飞快

我们测试了 NVIDIA 新发布的 Llama Nemotron Super 1.5 模型,把它塞进 CrewAI 里跑了一下。几分钟就部署好了,在 CrewAI Flows 里跑得特别快。

现在模型发布多得看不过来,但这个引起了我们的注意。

NVIDIA Llama Nemotron Super 1.5 是一个生产级、开放权重的模型,专为在企业环境中快速、灵活运行而设计。我们自然直接把它扔进了 CrewAI。

太长不看版

- 部署简单

- 集成顺畅

- 在结构化工作流中表现良好

- 工具调用循环时偶尔会不受约束

- 配合 CrewAI Flows 使用效果最佳

具体测试结果如下。你可以在 GitHub 仓库 找到我们使用 CrewAI Flow 进行底层控制和速度测试的演示。

几分钟跑通工作流

我们用 vLLM 在 4 块 NVIDIA H100 GPU 上启动了这个模型,几乎没遇到任何阻碍。没有奇怪的配置,也不需要微调。

模型部署好后,接入 CrewAI 就像下面这样简单:

llm = LLM(

model="text-completion-openai/nemotron",

temperature=1,

top_p=0.95,

api_base="<MODEL_API_BASE>",

max_tokens=10000,

)

一个小技巧:温度参数有个最佳范围(大约 0.6 - 1.2),在我们的多智能体编排测试中,这个范围能带来更好的结果。

CrewAI 的完整提示控制与工具支持

值得强调的是,CrewAI 让你能完全控制其内部提示。

在这次测试中,我替换了所有内部指令——Nemotron 处理得很好。

工具调用能力扎实,无论是否开启推理模式,它都能作为智能体完成任务。尽管是 49B 的模型,只需要对智能体提示做一些微调,保持指令简单清晰即可。

CrewAI Flows:最佳拍档

最好的体验是把模型放进 CrewAI Flows——这是我们低层、模块化的编排层,它在这里跑得特别快!

Flows 是为现实世界的自动化而生的:

- 有时你只想让 LLM 丰富一封邮件内容。

- 有时你需要完整的智能体协作。

- 有时呢?你两者都需要。

有了 Flows,你不需要做选择。你可以根据工作流的需求进行编排——不多不少,恰到好处。

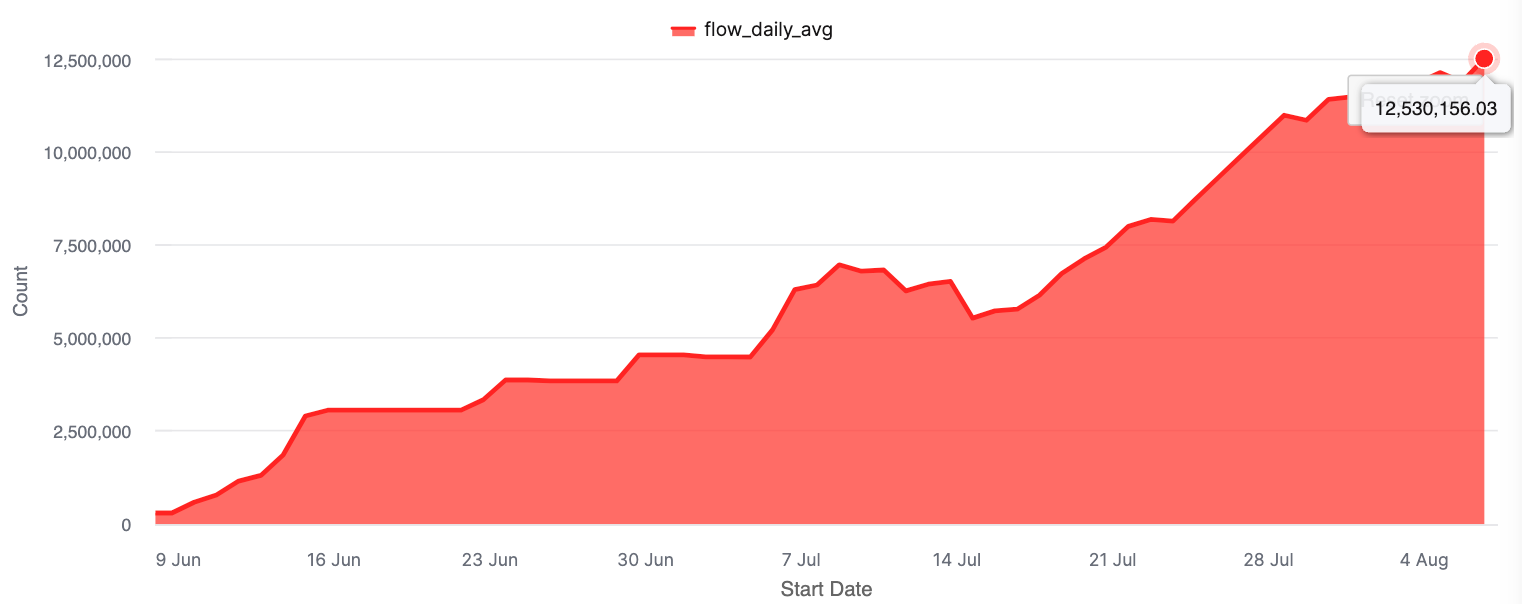

CrewAI Flows 现在每天处理 超过 1200 万次执行,用例覆盖金融、政府到现场运营。

大局观:结构化智能体

大多数平台仍然只推一种模式,这限制了模型的选择:

- 智能体

- 图

- 聊天机器人

但真实的团队工作横跨一个 智能体谱系,这对于像 NVIDIA Llama Nemotron Super 1.5 这样的模型尤其有帮助。这种谱系思维让你可以从简单开始,逐步扩展:

- 基于规则的流程

- 临时性的 LLM 调用

- 智能体委托(需要时)

- 完全自主的智能体团队(当投资回报率明确时)

发一条 Slack 消息不需要用图。丰富一封邮件也不需要 50 个 Token 的提示链。

你只需要 在正确的时间使用正确的结构。CrewAI Flow 提供了这种能力——而像 Nemotron 这样的模型正好能融入其中。

最终结论

NVIDIA 的 Llama Nemotron Super 49B 是一个 可部署的资产——启动快、易于编排、能直接接入工作流。

我们会继续在 Flows 中测试它,并很快分享更多现场演示。同时,要向 NVIDIA 团队致敬,他们发布了一个真正对企业 AI 产生影响的模型。

觉得有用?分享给更多人