Moonlake:用游戏引擎构建因果世界模型

深度Latent Space2026年4月2日4 分钟阅读

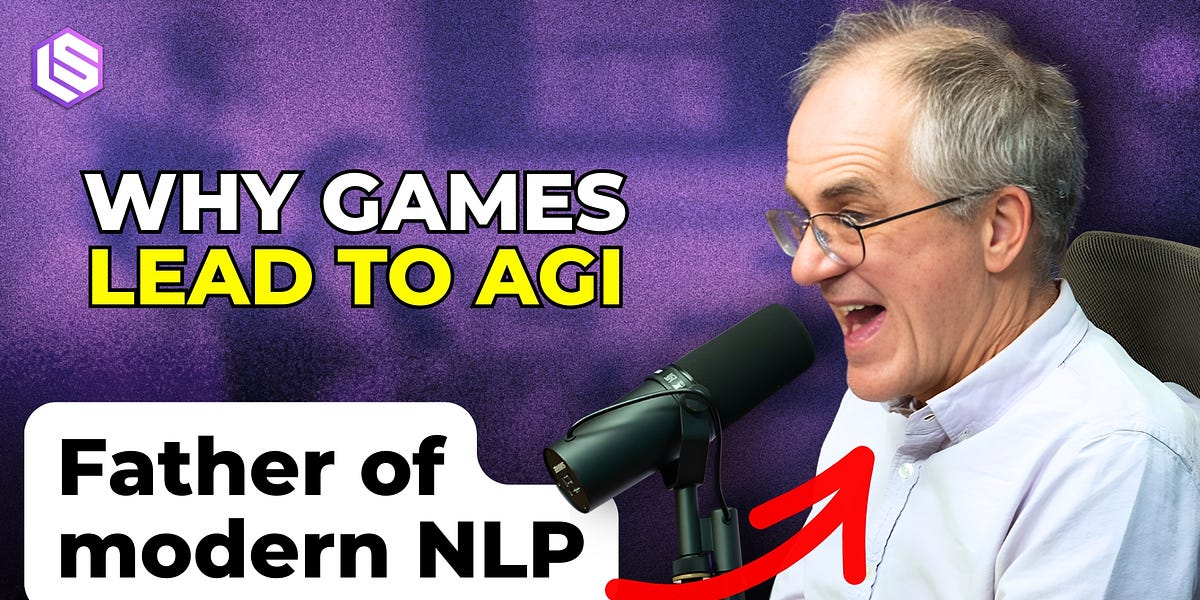

Moonlake AI 创始人 Chris Manning 和 Fan-yun Sun 认为,构建高效、可交互、多模态的世界模型(World Models)需要结构(Structure)和因果性(Causality),而不仅仅是规模(Scale)。他们从游戏引擎(Game Engines)入手,通过智能体(Agents)引导,构建能长期运行、支持多玩家的交互式世界。

本文编译自 Moonlake: Causal World Models should be Multimodal, Interactive, and Efficient — with Chris Manning and Fan-yun Sun,版权归原作者所有。

觉得有用?分享给更多人