多节点训练实战:GPU集群如何加速大模型训练

指南2026年1月12日6 分钟阅读

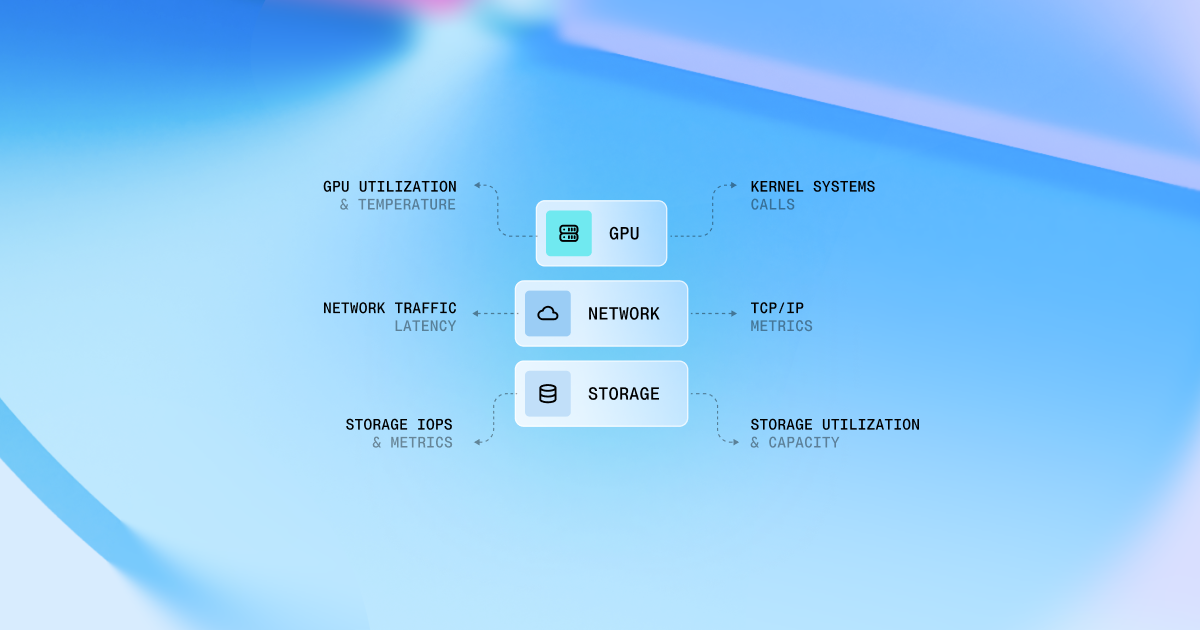

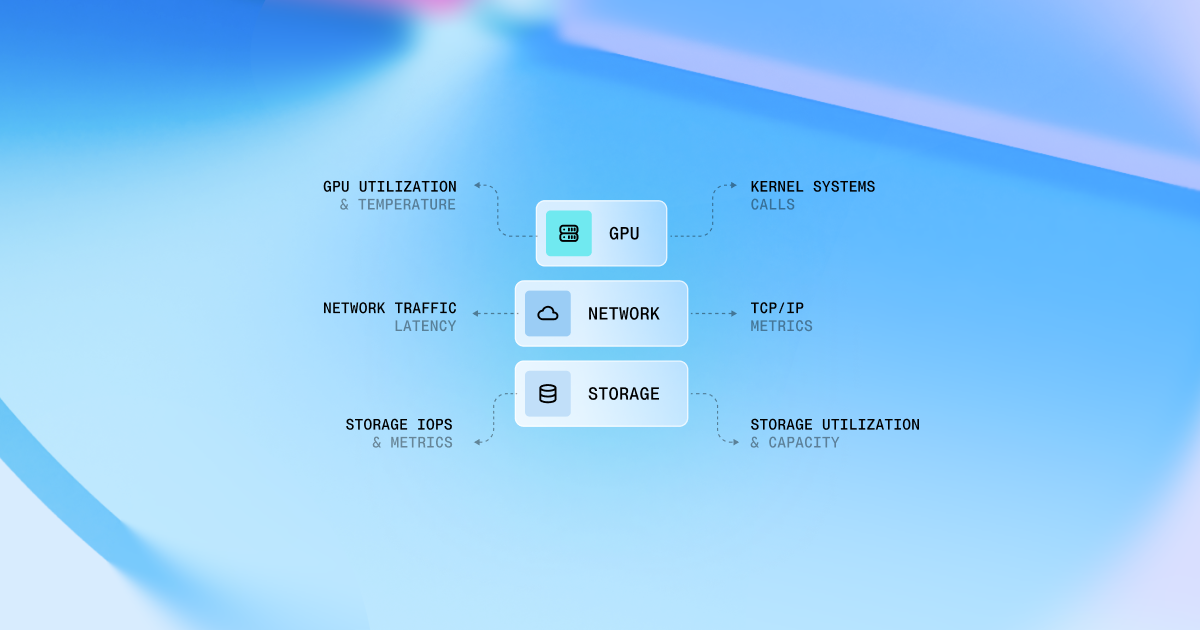

训练千亿参数大模型,单节点已无法胜任。多节点GPU集群将训练时间从数月压缩到数天,但网络配置不当会让GPU利用率跌至40%。本文详解分布式训练的技术原理与实战步骤。

觉得有用?分享给更多人

觉得有用?分享给更多人

Google 搜索推出 AI 信息智能体功能,用户可创建多个智能体在后台 24/7 监控股市、航班、新闻等话题,并在有重大变化时主动推送摘要和链接。该功能将于今夏面向 AI Pro 和 Ultra 订阅用户首发。

Google 在 I/O 大会上宣布 Android Studio 支持 GPT 和 Claude 模型,开发者可选用不同模型构建应用。Android CLI 发布 1.0 稳定版,支持 AI 智能体操作。