拆解智能体:编码助手的六大组件

深度2026年4月5日6 分钟阅读

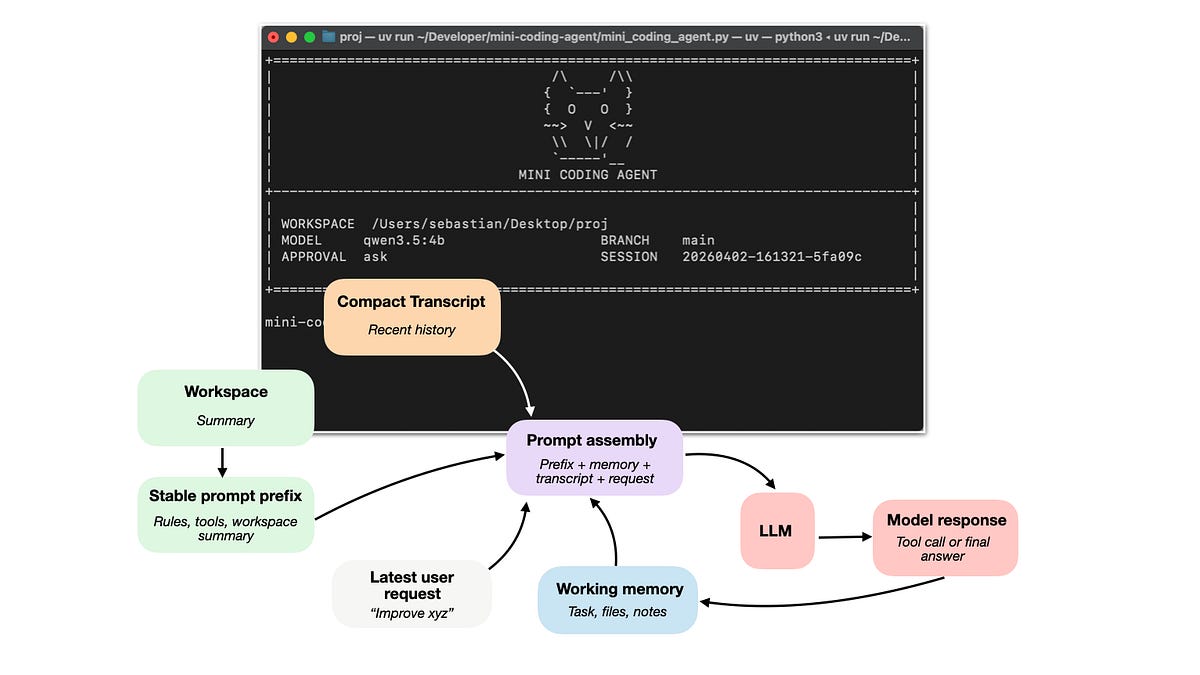

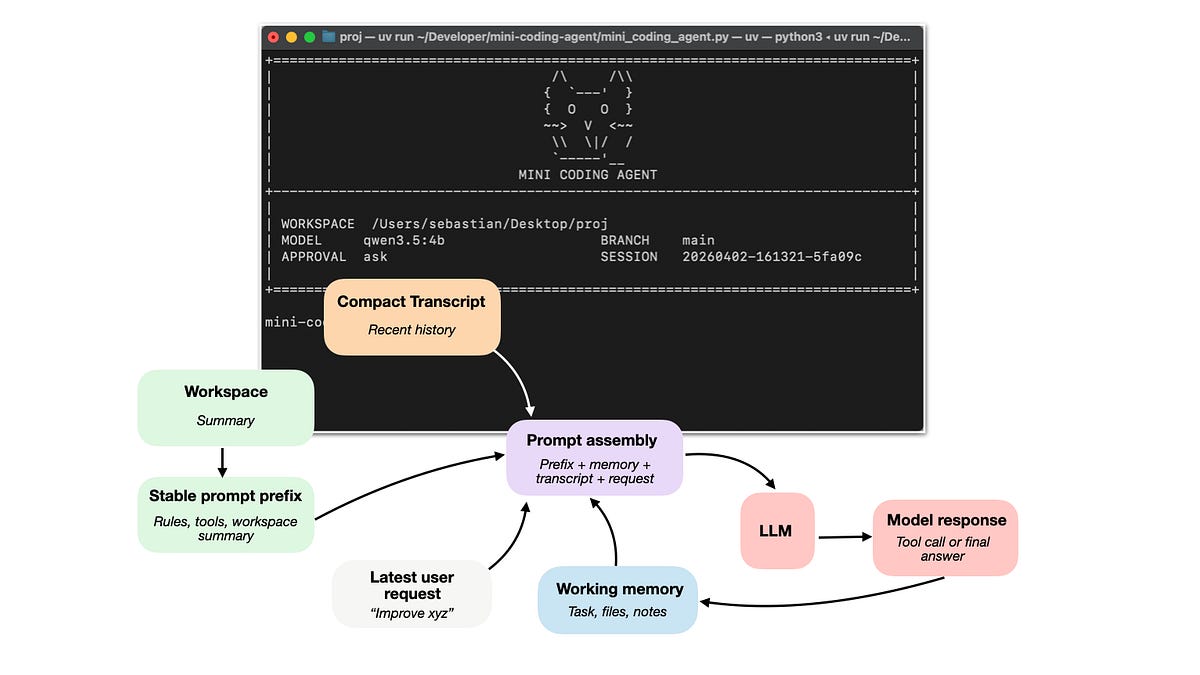

为什么 Claude Code 和 Codex 比直接用大语言模型聊天更强大?关键在于它们背后的智能体执行框架(Harness)。本文作者 Sebastian Raschka 拆解了编码智能体的六大核心组件,并开源了一个纯 Python 实现的 Mini Coding Agent 作为示例。

本文编译自 Components of A Coding Agent,版权归原作者所有。

觉得有用?分享给更多人

觉得有用?分享给更多人

本文提出将成对排序提示(PRP)重排序重新定义为从含噪成对比较中进行主动学习的问题,并引入随机方向查询来消除位置偏差。实验表明,该方法在调用受限场景下显著提升了NDCG@10,且可直接替代现有排序器。

本研究针对工业资产运维场景中的代理计划执行流水线,提出时序语义缓存与MCP工作流优化(包括磁盘缓存与依赖感知并行执行)两种方案。实验表明,工作流优化实现1.67倍加速、延迟降低40%,而时序语义缓存在命中时达到30.6倍加速,并揭示了纯语义缓存在参数密集查询下的失效模式。该工作为工业代理基准测试中的缓存策略设计提供了关键分析。