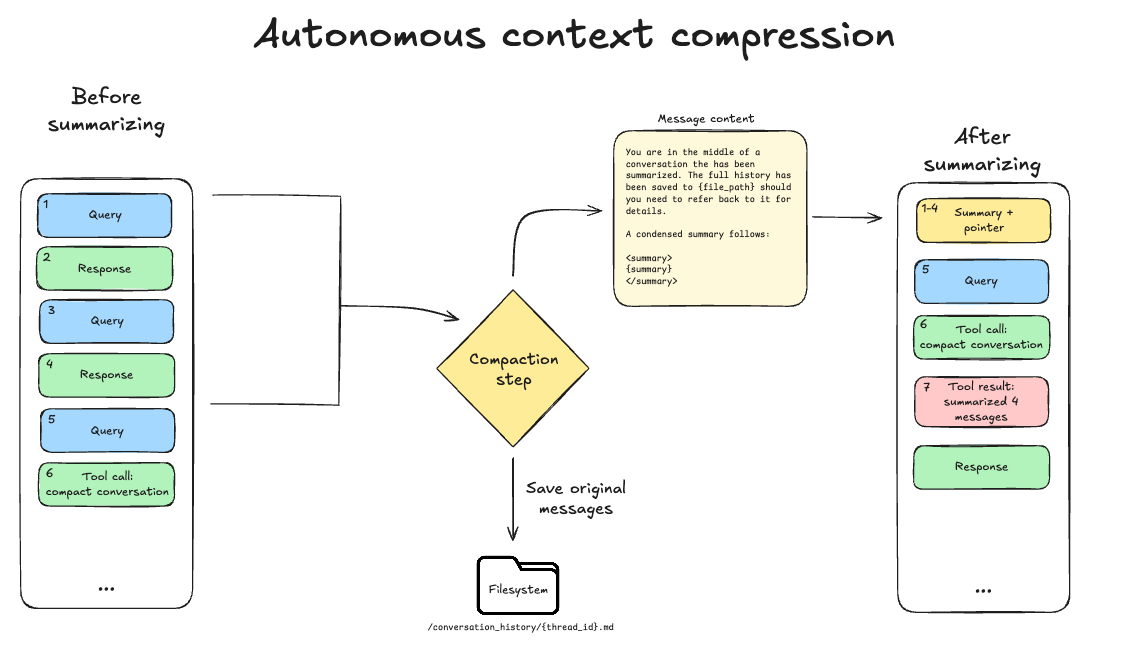

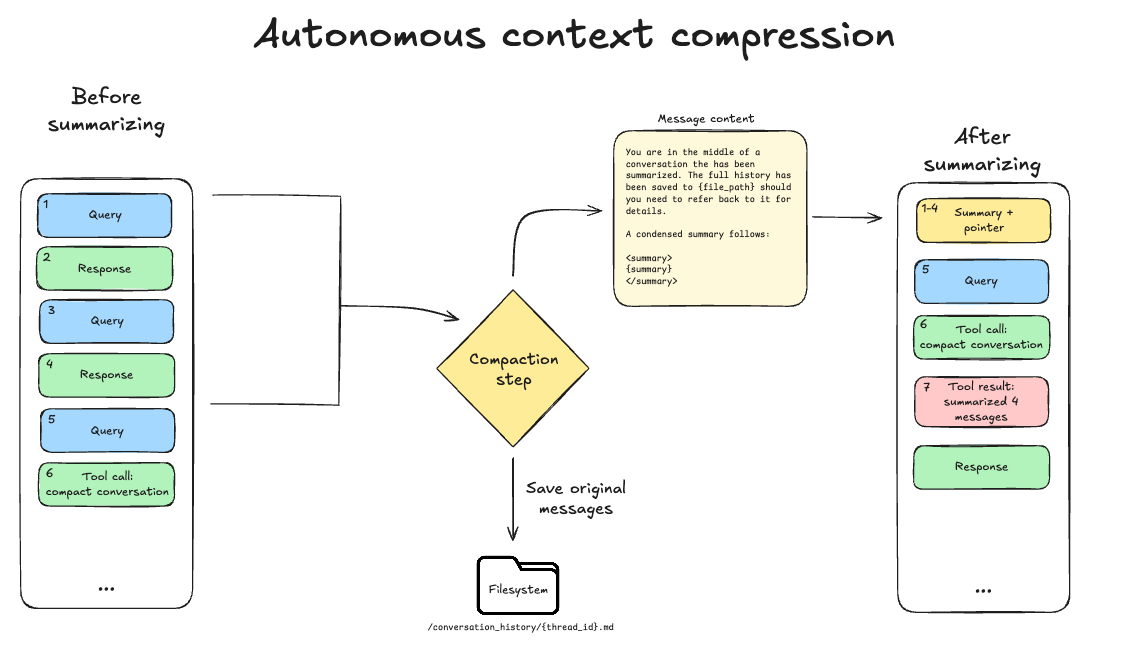

Deep Agents 新增自主上下文压缩工具

指南LangChain2026年3月11日4 分钟阅读

Deep Agents SDK 和 CLI 新增了一个工具,让模型能在合适时机自主压缩上下文窗口。这能减少上下文腐化,避免在复杂任务中途打断工作流。

本文编译自 Autonomous context compression,版权归原作者所有。

觉得有用?分享给更多人

觉得有用?分享给更多人

Google 搜索推出 AI 信息智能体功能,用户可创建多个智能体在后台 24/7 监控股市、航班、新闻等话题,并在有重大变化时主动推送摘要和链接。该功能将于今夏面向 AI Pro 和 Ultra 订阅用户首发。

Google 在 I/O 大会上宣布 Android Studio 支持 GPT 和 Claude 模型,开发者可选用不同模型构建应用。Android CLI 发布 1.0 稳定版,支持 AI 智能体操作。