2025年12月:编程的转折点

深度Latent Space2026年2月26日6 分钟阅读

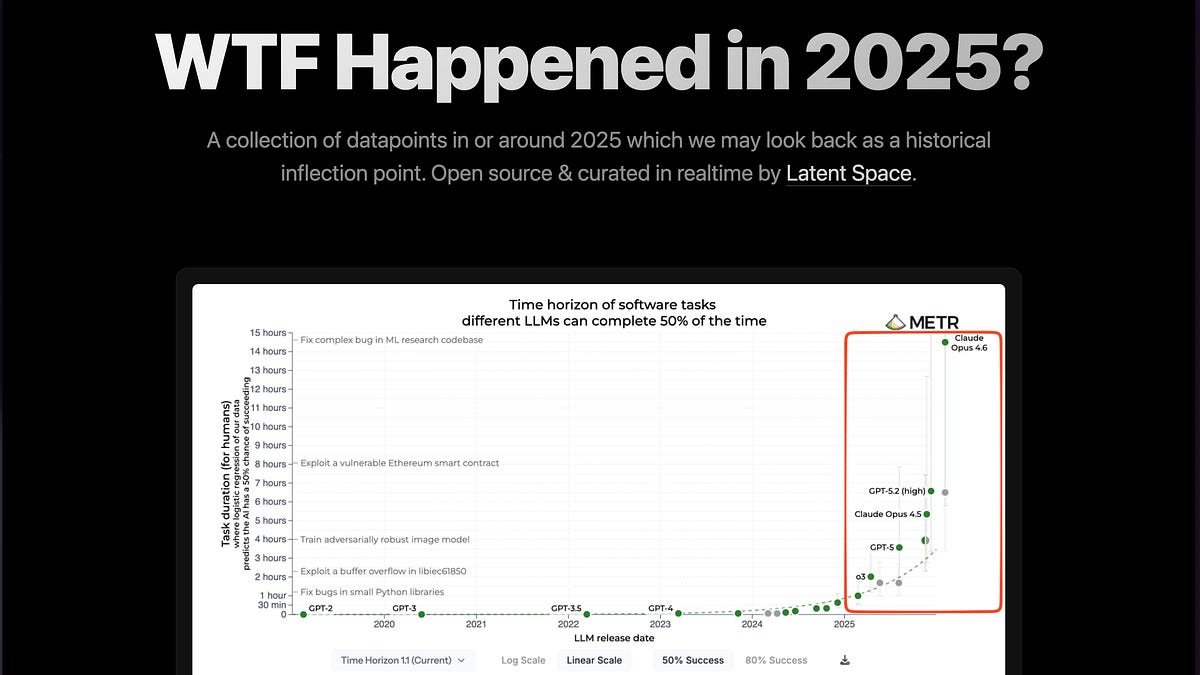

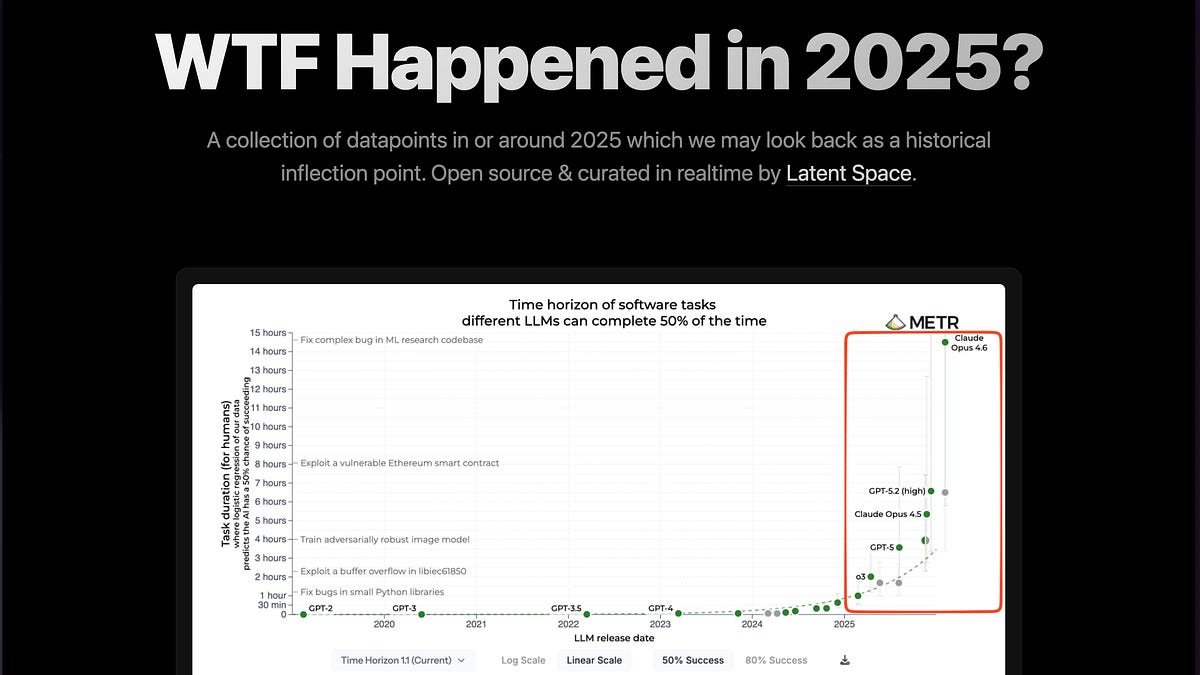

Andrej Karpathy 和 Greg Brockman 都指出,2025年12月是编程的质变时刻。Claude Code 已能自我托管,并贡献了约5%的 GitHub 提交。

本文编译自 [AINews] WTF Happened in December 2025?,版权归原作者所有。

觉得有用?分享给更多人

觉得有用?分享给更多人

动态工作流让 Claude 像一支开发团队而非单个 AI 那样工作。实测中,它在 7 分钟内构建了一个 CLI 工具,跑通了 62 个测试,成本约 3-5 美元。相比之下,单智能体花了 10 分 42 秒,成本 2.25 美元,但遇到长任务时上下文窗口会成为瓶颈。动态工作流在小任务上优势不大,但在大规模并行场景下潜力巨大。

企业Agent的瓶颈已经从模型能力转向治理下的构建吞吐量。CrewAI与Snowflake深度集成,提供治理编排模式:Snowflake负责数据层的权限与信任,CrewAI负责Agent的构建与运行时控制,让更多业务人员能在安全边界内构建Agent。