Nano Banana 2 发布:图像生成新标杆,价格减半

深度Latent Space2026年2月27日5 分钟阅读

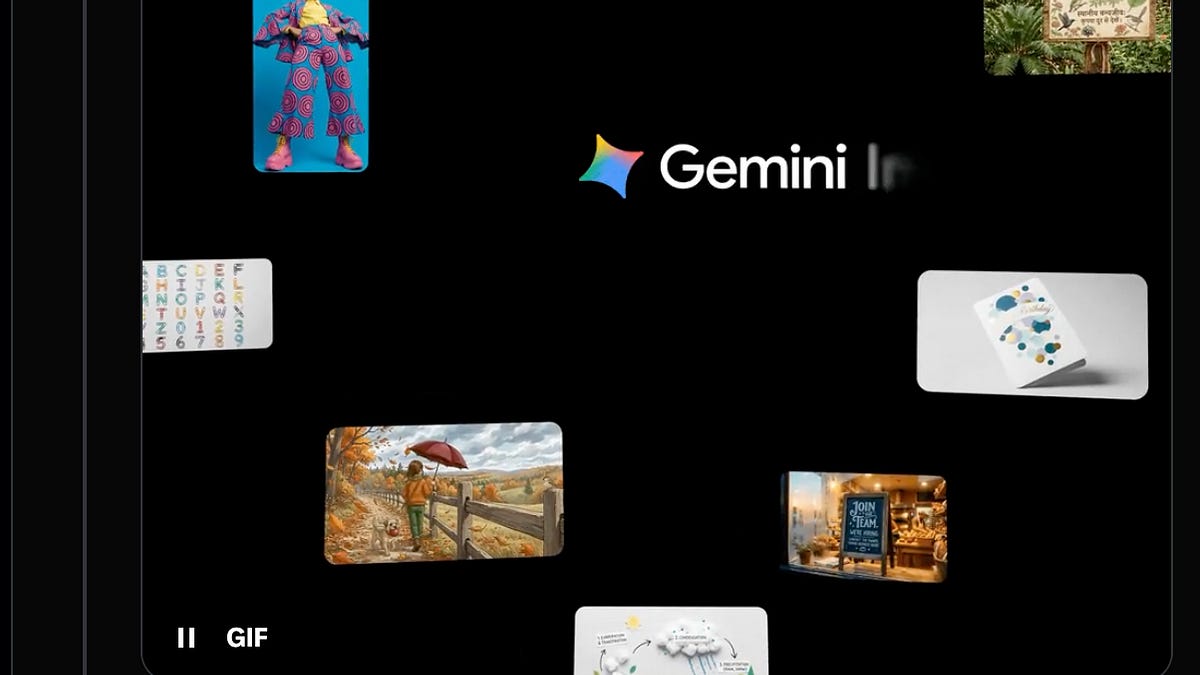

Google 推出 Nano Banana 2(Gemini 3.1 Flash Image Preview),在 Arena 和 Artificial Analysis 评测中位列图像模型第一,但价格仅为同类产品的一半。模型支持实时搜索增强生成和角色一致性,已集成到 Gemini 生态和第三方产品中。

本文编译自 [AINews] Nano Banana 2 aka Gemini 3.1 Flash Image Preview: the new SOTA Imagegen model,版权归原作者所有。

觉得有用?分享给更多人